这个Pages展示本项目的开发计划和项目文档

RK3588 NPU 驱动开发路线图

进度总览

当前状态:电源域管理 (Power Domain) 目标:将添加了npu驱动的starry编译拷贝到开发板验证探测

实际计划

第一阶段:环境验证与基础初始化

1. 理论与环境准备

-

阅读手册与 Demo

- 研读 RK3588 技术参考手册中 NPU 章节。

- 分析 RKNN Toolkit2 的官方 Demo,理解从模型加载到推理的完整数据流

-

实体机环境验证 (基于 StarryOS 比赛版)

- 编译并烧录比赛版本的 StarryOS 代码到 RK3588 实体板。

- 成功运行一个简单的文本生成模型,确保硬件和工具链正常。

-

整理 StarryOS 对 RK3588 NPU 驱动的逆向成果

-

寄存器地图

- 按模块梳理:PC / CORE / CNA / DPU / PPU / SDMA / DDMA / GLOBAL

- 对每个寄存器记录:offset、字段含义、读写属性、默认值/复位值、关联流程

- 标注来源:TRM / Linux rknpu 驱动

-

提交协议与数据结构

-

整理

DRM_IOCTL_RKNPU_*ioctl 列表与语义(Action / MemCreate / MemMap / MemDestroy / MemSync / Submit) -

对齐结构体布局:

rknpu_mem_create/rknpu_mem_map/rknpu_task/rknpu_submit(字段意义与对齐) -

梳理

mmap(offset)规则(handle 与 offset 的编码/解码约定)

-

整理

-

任务提交流程(时序 + 状态机)

- 从“用户态提交”到“硬件执行完成”的完整时序

- 失败路径:超时、异常中断状态、非法参数

-

寄存器地图

第二阶段:异步推理支持

目标:将当前同步阻塞轮询的任务提交改为中断驱动的异步模式,提交任务后 CPU 不再空转等待,NPU 完成后通过中断通知。

实现情况

- 中断处理 — 实现 IRQ 驱动模式,CPU 通过 WFI 指令进入低功耗等待,NPU 完成后触发中断唤醒 CPU

-

异步等待机制 — 实现

wait_all_npucore函数,支持多核心并行等待,每个核心独立触发中断 -

并发安全 — 每个核心维护独立的

irq_status原子变量,避免多核并发访问冲突 - 超时与错误恢复 — 实现中断状态检查和错误传播机制,异常时正确上报错误码

第三阶段:NPU多任务并发运行

目标:支持多个NPU计算任务同时在NPU多核上进行

实现情况

-

硬件资源隔离 — 验证 3 个 NPU 核心的 PC/CORE/CNA 等寄存器 per-core 独立,GLOBAL 寄存器通过

core_idx参数隔离 - GEM 内存隔离 — 实现 per-core 的 regcmd 缓冲区分配,每个核心使用独立的 DMA 地址空间

-

核心分配策略 — 实现

subcore_task机制,支持灵活的核心分配,QKV 三核并行、Wo 单核等混合调度

项目周报

按周记录 RKNN NPU 驱动开发进展。

第一周开发日志(1.25-1.31)

工作总结

- 基础知识学习 — 学习 NPU 原理、AI 模型运行原理、驱动在整个推理链条中的角色

- RKNN Toolkit2 仿真验证 — 下载套件,阅读 demo 代码,在 x86 仿真器上跑通测例

基础知识学习

刚接到 NPU 驱动开发任务时,虽然听说过 NPU,但对它实际是什么、解决什么问题、工作原理、如何运行都不了解。花了一天时间系统学习了以下内容:

- NPU 是什么 — 神经网络处理单元,专为矩阵运算和推理加速设计的硬件

- AI 模型的本质 — 本质上是一个函数,是大量矩阵乘法配上激活函数。训练是拟合参数,推理是执行前向传播

- 模型格式与转换 — ONNX → RKNN 格式转换,量化,以及模型在 NPU 上的执行流程

- 驱动在整个链条中的角色 — 用户态库(

librknnrt.so)通过 ioctl 与内核驱动通信,驱动负责任务调度、DMA 搬运、寄存器操作

RKNN Toolkit2 套件与仿真验证

上 Rockchip 官网下载了 rknn-toolkit2 套件,发现里面包含一个 仿真器,可以在 x86 主机上模拟 RKNPU 的部分功能。阅读了 demo 代码,理解了 RKNN 推理的基本 API 调用流程:

rknn_init()来初始化npu执行上下文 → rknn_inputs_set()读写npu寄存器设置输出输出参数 → rknn_run()写npu寄存器提醒npu开始工作和运行 → rknn_outputs_get()npu通过中断通知操作系统,用户库从约定位置读取结果 → rknn_destroy()销毁释放npu执行上下文

第二周开发日志(2.1-2.7)

工作总结

- 开发板验证通过 — 在 OrangePi 5 Plus(RK3588)上部署 StarryOS(NPU 版本),成功跑通 RKNN 推理测例

- 闭源库逆向文档整理 — 整理了

librknnrt.so逆向成果、完整寄存器语义、模型推理全链条,发布至 GitHub Pages - 驱动骨架搭建 — 创建

axnpu-rknn独立 crate,编写 DTB 设备探测代码,通过rdrive框架自动匹配 NPU 设备 - DRM 框架初步实现 — 创建

axdrmcrate,实现 GEM 内存对象管理和 ioctl 编码解析与分发机制

开发板验证

搭载 RK3588 芯片的 OrangePi 5 Plus 开发板到了之后,将带有 NPU 支持的 StarryOS 版本(atomgit 仓库)部署到开发板上,成功跑通测例,验证了 NPU 驱动在 StarryOS 上的可行性。

闭源库逆向与文档整理

花了 3 天时间系统整理了以下内容:

librknnrt.so闭源库逆向成果 — 梳理了用户态库的内部调用流程、ioctl 命令、内存管理机制- 寄存器语义 — 从官方 TRM 手册和 RKNN 开源内核驱动(C 语言版本)中,整理了完整的寄存器描述和语义

- 模型推理全链条 — 从

rknn_init到rknn_destroy的完整生命周期,包括任务提交流程、状态机、DMA Fence 路径等

文档链接:https://qc-gpu-driver.github.io/starryos-pulsar/documents/docs.html

这份文档不仅方便自己开发时查阅,也相当于一份社区参考文档,我也会一直维护和验证的,方便更多对 RKNN NPU 驱动感兴趣的开发者查阅和使用。

驱动骨架编写

最初尝试直接在 arceos/modules/ 下创建 axnpu-rknn 驱动模块,但遇到了 workspace 循环依赖问题——ArceOS 的 axdriver_block 锁定的版本缺少 ahci feature,而 Cargo workspace 会全量解析所有 members 的依赖,导致整个 workspace 编译失败。

参考 StarryOS(NPU 版本)的做法,将驱动模块移动到 Starry 根目录下独立开发,等完善后再集成回 arceos。

编写了 dtbparse.rs,利用 ArceOS 的 rdrive 框架通过设备树(DTB)自动探测 NPU 设备:

#![allow(unused)] fn main() { module_driver! { name: "RKNPU", level: ProbeLevel::PostKernel, priority: ProbePriority::DEFAULT, probe_kinds: &[ ProbeKind::Fdt { compatibles: &["rockchip,rk3588-rknn"], on_probe: probe_rknpu } ], } fn probe_rknpu(info: FdtInfo<'_>, dev: PlatformDevice) -> Result<(), OnProbeError> { let name = info.node.name(); // 提取 MMIO 基址: 0xfdab0000, 大小: 0x9000 let mut regs = info.node.reg().ok_or_else(|| { /* ... */ })?; let base_reg = regs.next().ok_or_else(|| { /* ... */ })?; let mmio_base = base_reg.address as usize; let mmio_size = base_reg.size.unwrap_or(0x9000); // 提取中断号: SPI 110, 111, 112(3 个 NPU 核心) // ... Ok(()) } }

module_driver! 宏会将驱动自动注册到 rdrive 框架,内核启动时遍历 DTB,匹配 compatible = "rockchip,rk3588-rknn" 后自动调用 probe_rknpu,无需手动调用。

DRM 框架搭建

创建了 driver/axdrm crate,作为用户态接口适配层:

GEM 内存对象管理 — 实现了 GemNumberAllocator(handle 编号分配/回收)、GemObject(物理地址、虚拟地址、fake offset)、GemHandle(自动回收的 RAII handle)

ioctl 编码解析 — 实现了 DRM ioctl 命令的解码函数:

| 函数 | 作用 |

|---|---|

ioctl_nr(cmd) | 提取 ioctl 编号(bits [7:0]) |

ioctl_type(cmd) | 提取类型字节(DRM = 'd' = 0x64) |

ioctl_size(cmd) | 提取参数大小(bits [29:16]) |

is_driver_ioctl(cmd) | 判断是否为驱动私有命令(nr >= 0x40) |

ioctl 分发机制 — 驱动通过 register_driver() 注册自己的 ioctl handler,dispatch_ioctl() 根据命令编号自动分发到对应驱动。NPU 驱动只需注册一个回调函数即可处理私有 ioctl。

第三周开发日志(2.8-2.14)

工作总结

- 修复 Axvisor 上 rsext4 文件系统导致的磁盘数据不一致问题 — 客户机写文件后重启出现 "block is free" 错误,定位为 rsext4 缓存未同步,在写操作后增加

sync_to_disk调用修复 - svd2rust 寄存器库重构 — 基于 svd2rust 工具生成类型安全的寄存器访问库,重构 rknpu 驱动核心,减少手动操作寄存器的出错概率

- 辅助注释与文档 — 利用 AI 为驱动代码添加详细注释,兼顾学习与开发效率

- 基于 WFI 的异步中断处理 — 实现了 NPU 中断的异步等待机制

修复 Axvisor 上 rsext4 文件系统磁盘数据不一致问题

问题

- 客户机执行文件写操作后重启,出现

block is free(双重释放,原来没有正确把1写回位图) (位图实际扫描使用的Block和超级块中的Block不一致)错误,磁盘数据损坏 - 如果启动的是 Linux 客户机,Linux 在启动过程中会因文件系统完整性校验失败而无法启动

分析

Linux 客户机的问题是由于 Axvisor 在启动客户机的最后时刻调用 mount_virtual_fs 时没有刷新文件系统,导致文件系统不一致。Linux 启动时进行文件系统完整性校验,发现不一致后拒绝启动,随后关机导致缓存丢失,最终造成文件系统损坏。

根源在于 rsext4 为提升运行时性能设计了多级缓存机制,但 Axvisor 在集成 rsext4 时,没有在文件写操作后进行数据同步。如果客户机修改文件后立即关机,缓存仍停留在内存中,不可避免地导致磁盘数据不一致。

解决方案

在 rsext4 的 ext4fs.rs 访问层中,对所有写操作调用 sync_to_disk 函数,确保数据及时同步到磁盘。虽然会带来一定的性能损失,但保证了文件系统的一致性。

开发板环境踩坑

本周在板端遇到了一系列棘手的环境问题,花了不少时间排查:

U-Boot 与启动链问题

- U-Boot 缺少网卡驱动 — 板载 U-Boot 不支持网络传输,只能通过串口

loady加载内核,debug 内核每次都要通过串口传内核很慢,每次修改都需要完整烧录StarryOS内核 - SPI 残留环境变量 — 从 OrangePi 官方 Ubuntu 镜像中提取干净的 U-Boot,制作 SPI 镜像刷入开发板。但刷完后发现 SPI 中残留了旧的 U-Boot 环境变量,导致启动失败,只能重新刷回 SPI 镜像

- eMMC 与 SD 卡混淆 — StarryOS 在开发板上扫描到板载 eMMC,但驱动却强制探测 SD 卡。起初误以为使用的是 SD 卡,经分析后确认实际使用的是板载 eMMC

后续 NPU 驱动工作开发路线决策

最初尝试将 NPU 驱动集成到 StarryOS 主线,但 HAL 层架构 axhal 与 somehal 存在冲突,RK3588 平台级代码集成涉及整个架构的大修改。为专注于 NPU 驱动核心功能开发,决定先在 StarryOS NPU 版本上开发,待主要功能完成后再移植回主线。

svd2rust 寄存器库重构

基于 svd2rust 工具重构 rknpu 驱动的寄存器访问层。

#![allow(unused)] fn main() { // 旧方式:手动偏移 + 裸指针 let status = unsafe { ptr.add(0x20).read_volatile() }; }

改进

通过 svd2rust 从 SVD 描述文件生成类型安全的寄存器库 rknpu-regs,每个寄存器字段都有明确的类型和文档:

#![allow(unused)] fn main() { // 新方式:类型安全 + 自动补全 + 文档 let status = core.pc().interrupt_status().read().bits(); core.pc().interrupt_clear().write(|w| unsafe { w.bits(INT_CLEAR_ALL) }); }

成果

- 生成了完整的寄存器定义,覆盖 PC、CNA、CORE、DPU、PPU、DDMA 等所有功能块

RknpuCore结构体封装了各功能块的访问方法,提供统一接口- 编译期类型检查杜绝了寄存器偏移量写错、位域宽度搞混等常见错误

AI 辅助注释

利用 AI 为 axnpu 驱动代码添加了详细的中文注释(关键函数的调用流程和参数说明)

既方便自己学习 NPU 硬件细节,也降低了后续开发和他人协作的门槛。

基于 WFI 的异步中断处理

实现了 NPU 任务完成的异步等待机制:

- NPU 核心执行完任务后触发中断

- CPU 通过 WFI(Wait For Interrupt)指令进入低功耗等待状态

- 中断到来时 CPU 被唤醒,读取中断状态寄存器,清除中断标志

- 返回任务执行结果

这为后续多核并发任务提交打下了基础——每个 NPU 核心可以独立触发中断,CPU 侧可以并行等待多个核心的完成通知。

第五周开发日志(2.22-2.28)

工作总结

- RK3588 NPU 三核并行矩阵乘法实现 — 扩展 Transformer 结构体支持 3 套 regcmd 缓冲区,实现

matmul_npu_3core_qkv函数,将 QKV 三个矩阵乘法并行提交到 3 个 NPU 核心,板端验证推理成功 - 驱动多核提交流程重构 — 修改

submit_ioctrl实现批量任务分配,支持一次 ioctl 向多个核心提交任务,新增wait_all_npucore并行等待机制

验证结果

板端运行日志显示多核并行成功:

[261.640936] Total tasks to submit: 3, active cores: 3, max batch size: 4095

[261.650710] Total tasks to submit: 1, active cores: 1, max batch size: 4095

[262.295035] Total tasks to submit: 3, active cores: 3, max batch size: 4095

...

Once upon a time...

3 tasks, 3 cores表示 QKV 三核并行成功1 tasks, 1 core表示后续的wo矩阵乘法(单核)- 模型推理输出 "Once upon a time..." 验证结果正确

驱动多核提交流程重构

批量任务分配

重构 submit_ioctrl 函数,支持将用户空间的任务数组自动分配到多个 NPU 核心:

#![allow(unused)] fn main() { pub fn submit_ioctrl(&mut self, args: &mut RknpuSubmit) -> Result<(), RknpuError> { // 1. 刷新缓存,确保 NPU 能看到 CPU 写入的数据 self.gem.comfirm_write_all()?; // 2. 提取活跃的核心任务 let active_subcore: Vec<&RknpuSubcoreTask> = args.subcore_task.iter() .filter(|s| s.task_number > 0).collect(); // 3. 批量提交到多个核心 while task_iter < task_iter_end { let task_batch = active_subcore.len().min(task_iter_end - task_iter); let submit_tasks = unsafe { core::slice::from_raw_parts_mut(task_ptr.add(task_iter), task_batch) }; // 并行启动每个核心的任务 for idx in 0..active_subcore.len().min(task_batch) { self.base[idx].start_execute_one(idx, &self.data, &mut submit_tasks[idx], args)?; } // 并行等待所有核心完成 self.wait_all_npucore(self.wait_fn, int_mask, submit_tasks)?; task_iter += task_batch; } // 4. 使缓存无效,确保 CPU 能读取 NPU 写入的结果 self.gem.prepare_read_all()?; Ok(()) } }

并行等待机制

新增 wait_all_npucore 函数,实现多核心并行等待:

#![allow(unused)] fn main() { pub fn wait_all_npucore(&self, normal_wait_fn: Option<fn()>, int_mask: Vec<u32>, submit_tasks: &mut [RknpuTask]) -> Result<(), RknpuError> { let mut done: [bool; 3] = [false; 3]; if let Some(wait) = normal_wait_fn { // IRQ+WFI 模式:CPU 休眠等待中断 loop { let status: Vec<u32> = self.base.iter() .map(|core| core.irq_status.load(Ordering::Acquire)).collect(); // 检查每个核心的完成状态 for idx in 0..submit_tasks.len() { if status[idx] & int_mask[idx] > 0 { self.base[idx].clean_interrupts(); self.base[idx].irq_status.store(0, Ordering::Release); submit_tasks[idx].int_status = int_mask[idx] & status[idx]; done[idx] = true; } } // 所有核心都完成则退出 if done[..submit_tasks.len()].iter().filter(|&d| !d).count() == 0 { break; } // CPU 进入低功耗等待 (wait)(); } } else { panic!("[NPU] busy-poll mode not implemented for multi-core wait"); } Ok(()) } }

RK3588 RKNPU 开发文档

本文档基于 RockChip官方开源仓库和 StarryOS 仓库中对 RK3588 NPU 运行时库(闭源 librknnrt.so)及内核侧 RKNPU DRM 驱动的逆向与复现成果,整理为三个核心章节:

文档结构

| 章节 | 内容 | 适用场景 |

|---|---|---|

| RKNN 硬件特性 | 三核架构、数据精度与算力、支持的推理框架 | 了解硬件能力边界 |

| 寄存器地图 | 按模块梳理rknpu内部各个寄存器的位域、读写属性 | 写驱动、调试硬件交互 |

| IOCTL协议与数据结构 | DRM_IOCTL_RKNPU_* 命令表,结构体布局,flags枚举,mmap 规则 | 实现ioctl分发,对齐用户态ABI |

| 任务提交流程 | 从用户态提交到硬件执行完成的完整时序逻辑,包含状态机和各种失败路径 | 查询job生命周期 |

| 当前提交-IRQ 边界快照恢复系统 | 总结 step-submit、owner 切换、IRQ 边界快照/写坏/恢复/校验,以及相关 struct 的职责 | 整理当前实验实现、查数据结构分工、回顾抢占边界语义 |

来源标注约定

文档中对每条信息标注来源,使用以下标记:

- Linux rknpu 驱动 — 来自Rockchip官方仓库中rk3588-npu内核驱动代码

- rknpu-ioctl.h — 来自 Linux rknpu 驱动include目录的 ioctl 头文件

- StarryOS Rust 驱动 — 来自

drivers/rknpu/src/的 Rust 复刻实现 - 逆向推断 — 基于代码行为推断,无官方文档确认

术语速查

| 术语 | 含义 |

|---|---|

| GEM | Graphics Execution Manager,DRM 子系统的内存对象管理框架 |

| PC | Program Counter / 任务控制器,NPU 的命令流执行引擎 |

| CNA | Convolution Neural-network Accelerator,卷积加速单元 |

| DPU | Data Processing Unit,数据后处理单元 |

| PPU | Pooling Processing Unit,池化处理单元 |

| DDMA/SDMA | Data DMA / System DMA,数据搬运引擎 |

| IOVA | I/O Virtual Address,IOMMU 映射后的设备侧虚拟地址 |

| fence | DMA fence,用于 job 完成通知与跨设备同步的内核原语 |

RKNN 手册

本栏汇总 RK3588 NPU 的硬件参考与软件接口文档。

硬件手册

NPU 三核架构、数据精度、寄存器位域详解。

IOCTL 协议

DRM_IOCTL_RKNPU_* 命令表、结构体布局、mmap 规则。

任务提交流程

从用户态提交到硬件执行完成的完整时序。

RKNN 硬件手册

来源:RK3588 TRM Chapter 36 RKNN

本章汇总 RK3588 NPU 硬件相关文档,包括硬件特性概览与完整寄存器参考。

RKNN 硬件特性

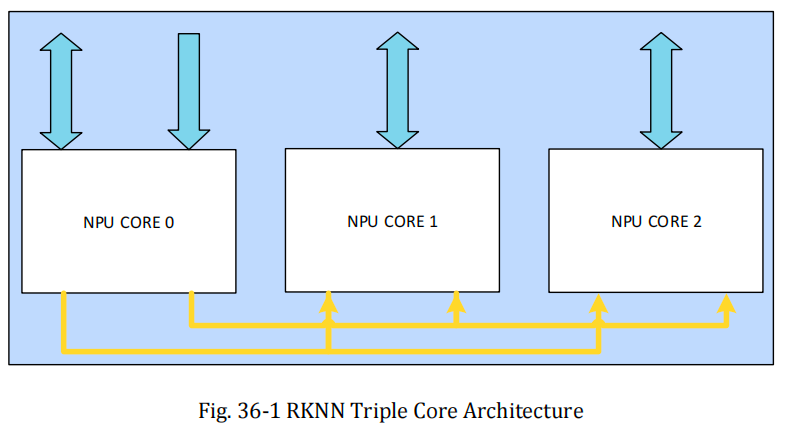

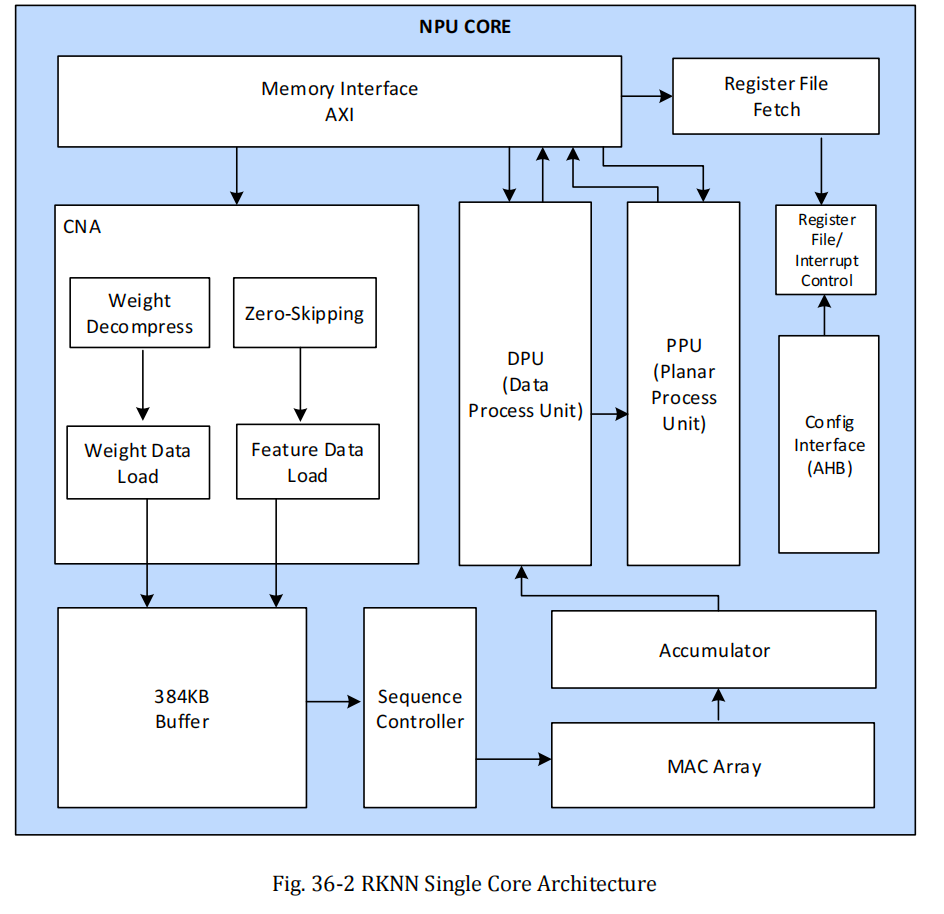

- 三核 NPU,支持三核协同 / 双核协同 / 单核独立

- 每核 384KB 内部缓冲,AHB 配置接口 + AXI 数据接口

- 支持 INT4 / INT8 / INT16 / FP16 / BF16 / TF32 多精度推理

- 功能流水线:CNA(卷积)→ CORE(MAC)→ DPU(后处理)→ PPU(池化)

- 激活函数:ReLU / Leaky ReLU / ReLUx / Sigmoid / Tanh / Softmax

- 池化:Average / Max / Min Pooling

寄存器图

每个核心拥有独立 64KB 寄存器空间,按功能模块划分:

| 模块 | 地址范围 | 功能 |

|---|---|---|

| PC | 0x0000 ~ 0x0FFF | 任务控制器 / 命令流引擎 |

| CNA | 0x1000 ~ 0x1FFF | 卷积神经网络加速单元 |

| CORE | 0x3000 ~ 0x3FFF | MAC 核心控制 |

| DPU | 0x4000 ~ 0x4FFF | 数据后处理单元 |

| DPU_RDMA | 0x5000 ~ 0x5FFF | DPU 读 DMA |

| PPU | 0x6000 ~ 0x6FFF | 池化处理单元 |

| PPU_RDMA | 0x7000 ~ 0x7FFF | PPU 读 DMA |

| DDMA | 0x8000 ~ 0x8FFF | Data DMA 引擎 |

| SDMA | 0x9000 ~ 0x9FFF | System DMA 引擎 |

| GLOBAL | 0xF000 ~ 0xFFFF | 全局使能掩码 |

RKNN 硬件特性概览

来源:RK3588 TRM Chapter 36 RKNN

RKNN 是专用于神经网络的处理单元,旨在加速人工智能(AI)领域的神经网络运算,涵盖机器视觉和自然语言处理等方向。AI 的应用范围正在不断扩大,目前已在多个领域提供功能支持,包括人脸追踪、手势与肢体追踪、图像分类、视频监控、自动语音识别(ASR)以及高级驾驶辅助系统(ADAS)。

核心特性

| 特性 | 说明 |

|---|---|

| 核心数量 | 三核 NPU(Triple NPU CORE) |

| 协作模式 | 支持三核协同、双核协同、单核独立工作 |

| 配置接口 | AHB 接口,仅用于寄存器配置(单次访问) |

| 数据接口 | AXI 接口,用于从内存取数据 |

| 内部缓冲 | 384KB × 3(每核 384KB) |

功能模块描述

AHB / AXI 接口

AXI 主接口用于从挂载在 SoC AXI 互联总线上的内存中取数据。AHB 从接口用于访问寄存器,进行配置、调试和测试。

神经网络加速引擎(Neural Network Accelerating Engine)

该引擎是神经网络运算的核心处理单元,包含卷积预处理控制器、内部缓冲区、MAC 阵列和累加器。它为识别功能提供并行卷积 MAC 运算,支持 INT4、INT8、INT16、FP16、BF16 和 TF32 数据类型。

数据处理单元(Data Processing Unit, DPU)

数据处理单元主要负责单数据运算,如 Leaky ReLU、ReLU、ReLUx、Sigmoid、Tanh 等激活函数。同时提供 Softmax、转置(Transpose)、数据格式转换等功能。

平面处理单元(Planar Processing Unit, PPU)

平面处理单元在数据处理单元输出之后执行平面操作,支持平均池化(Average Pooling)、最大池化(Max Pooling)、最小池化(Min Pooling)等。

寄存器配置取数单元(Register File Fetch Unit, PC)

寄存器配置取数单元通过 AXI 接口从外部系统内存中获取寄存器配置(即命令流),实现硬件自动配置各功能模块寄存器。

支持的数据精度与算力

| 数据类型 | 每周期 MAC 操作数(三核合计) |

|---|---|

| INT4 | 2048 × 3 = 6144 |

| INT8 | 1024 × 3 = 3072 |

| INT16 | 512 × 3 = 1536 |

| FP16 | 512 × 3 = 1536 |

| BF16 | 512 × 3 = 1536 |

| TF32 | 256 × 3 = 768 |

支持的推理框架

TensorFlow、Caffe、TFLite、PyTorch、ONNX NN、Android NN 等。

寄存器地图

RK3588 NPU 每个核心(共 3 核)拥有独立的寄存器空间,内部按功能模块划分为以下区域:

地址空间总览

| Base[15:12] | 模块 | 大小 | 地址范围 | 功能 |

|---|---|---|---|---|

4'h0 | PC | 4KB | 0x0000 ~ 0x0FFF | 任务控制器 / 命令流引擎 |

4'h1 | CNA | 4KB | 0x1000 ~ 0x1FFF | 卷积神经网络加速单元 |

4'h3 | CORE | 4KB | 0x3000 ~ 0x3FFF | MAC 核心控制 |

4'h4 | DPU | 4KB | 0x4000 ~ 0x4FFF | 数据后处理单元 |

4'h5 | DPU_RDMA | 4KB | 0x5000 ~ 0x5FFF | DPU 读 DMA |

4'h6 | PPU | 4KB | 0x6000 ~ 0x6FFF | 池化处理单元 |

4'h7 | PPU_RDMA | 4KB | 0x7000 ~ 0x7FFF | PPU 读 DMA |

4'h8 | DDMA | 4KB | 0x8000 ~ 0x8FFF | Data DMA 引擎 |

4'h9 | SDMA | 4KB | 0x9000 ~ 0x9FFF | System DMA 引擎 |

4'hF | GLOBAL | 4B | 0xF000 ~ 0xF004 | 全局使能掩码 |

来源说明:地址映射来自 RK3588 TRM Table 1-1 RKNN Address Mapping。

PC 寄存器块(Program Counter / 任务控制器)

基址:CORE_BASE + 0x0000 | 地址范围:0x0000 ~ 0x0FFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

PC 是 NPU 的命令流执行引擎,负责:从 DMA 地址读取寄存器命令流 → 按序写入各功能模块寄存器 → 触发执行 → 产生完成中断。

RKNN_pc_version(0x0000)

硬件版本寄存器(只读)。驱动通过 version + (version_num & 0xFFFF) 计算完整版本号。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RO | 0x0 | version | 硬件版本标识 |

RKNN_pc_version_num(0x0004)

硬件版本号寄存器(只读)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:0 | RO | 0x0 | version_num | 硬件版本编号 |

RKNN_pc_operation_enable(0x0008)

操作使能寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | op_en | PC 操作使能。0:禁用 PC 模块;1:使能 PC 模块,为每个 task 取寄存器配置 |

RKNN_pc_base_address(0x0010)

PC 基址寄存器,指定 DMA 指令流所在的内存地址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | pc_source_addr | PC 基址。DMA 指令流所在的内存地址 |

| 3:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | pc_sel | PC 模式选择。0:PC 模式,通过 AXI DMA 取寄存器配置;1:Slave 模式,通过 AHB 设置寄存器 |

RKNN_pc_register_amounts(0x0014)

每个 task 需要取的寄存器数量。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:0 | RW | 0x0 | pc_data_amount | 数据量。一个 task 需要取的寄存器数量 |

每条寄存器指令占 64 bit,格式如下:

| 位域 | 含义 |

|---|---|

[63:48] | 目标模块选择(哪个 block) |

[47:16] | 寄存器值 |

[15:0] | 各 block 内的偏移地址 |

模块选择位:

| Bit | 目标模块 |

|---|---|

| 56 | PC |

| 57 | CNA |

| 59 | CORE |

| 60 | DPU |

| 61 | DPU_RDMA |

| 62 | PPU |

| 63 | PPU_RDMA |

| 55 | 设置各 block 的 op_en |

示例:

64'h0081_0000_007f_0008将设置各 block 的 op_en(CNA, CORE, ..., PPU_RDMA)。注意:

op_en强烈建议放在寄存器列表末尾。在op_en之前,必须先设置64'h0041_xxxx_xxxx_xxxx。

RKNN_pc_interrupt_mask(0x0020)

中断掩码寄存器。置 1 使能对应中断。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16:0 | RW | 0x1FFFF | int_mask | 中断掩码(见下表) |

| Bit | 中断源 |

|---|---|

| 0 | CNA feature group 0 |

| 1 | CNA feature group 1 |

| 2 | CNA weight group 0 |

| 3 | CNA weight group 1 |

| 4 | CNA csc group 0 |

| 5 | CNA csc group 1 |

| 6 | CORE group 0 |

| 7 | CORE group 1 |

| 8 | DPU group 0 |

| 9 | DPU group 1 |

| 10 | PPU group 0 |

| 11 | PPU group 1 |

| 12 | DMA read error |

| 13 | DMA write error |

注意:在 PC 模式下,int_mask 设置的是最后一个 task 的中断掩码。

RKNN_pc_interrupt_clear(0x0024)

中断清除寄存器。写 1 清除对应中断位。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16:0 | W1C | 0x0 | int_clr | 中断清除(位定义同 int_mask) |

INT_CLEAR_ALL = 0x1FFFF(清除 bit0~bit16 全部中断)rknpu-ioctl.h

RKNN_pc_interrupt_status(0x0028)

中断状态寄存器(经过 mask 后的状态)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16:0 | W1C | 0x0 | int_st | 中断状态,与 mask 位做 AND(位定义同 int_mask) |

RKNN_pc_interrupt_raw_status(0x002C)

中断原始状态寄存器(未经 mask 的原始状态)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16:0 | W1C | 0x0 | int_raw_st | 中断原始状态(位定义同 int_mask) |

RKNN_pc_task_con(0x0030)

任务控制寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:14 | RO | 0x0 | — | 保留 |

| 13 | W1C | 0x0 | task_count_clear | 任务计数器清除。清除当前 task 计数器,建议在 task 启动前清除 |

| 12 | RW | 0x0 | task_pp_en | Ping-pong 模式使能。0:关闭,第二组寄存器在第一组 task 完成后才取;1:开启,第二组寄存器在第一组取完后立即开始取 |

| 11:0 | RW | 0x0 | task_number | 要执行的 task 总数 |

RKNN_pc_task_dma_base_addr(0x0034)

任务 DMA 基址寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | dma_base_addr | 任务基址。各 DMA(feature DMA、weight DMA、DPU DMA、PPU DMA)的地址设为偏移地址,AXI 总线上的最终地址 = 基址 + 偏移地址 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_pc_task_status(0x003C)

任务状态寄存器(只读)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:28 | RO | 0x0 | — | 保留 |

| 27:0 | RW | 0x0 | task_status | 任务状态(见下表) |

| 位域 | 含义 |

|---|---|

| [11:0] | 当前 task 计数器值 |

| [12] | 指示第一个 task 正在执行 / 第一个 task 的寄存器正在取 |

| [13] | 指示最后一个 task 正在执行 / 最后一个 task 的寄存器正在取 |

附:驱动层补充

中断状态归一化(rknpu_fuzz_status())

StarryOS Rust 驱动 在判定完成前,对 interrupt_status 做如下归一化处理:

| 位组 | 掩码 | 归一化规则 | 对应模块 |

|---|---|---|---|

| bit[1:0] | 0x03 | 任一非零 → 置 0x03 | CNA_FG |

| bit[3:2] | 0x0C | 任一非零 → 置 0x0C | CNA_WG |

| bit[5:4] | 0x30 | 任一非零 → 置 0x30 | CNA_CSC |

| bit[7:6] | 0xC0 | 任一非零 → 置 0xC0 | CORE |

| bit[9:8] | 0x300 | 任一非零 → 置 0x300 | DPU |

| bit[11:10] | 0xC00 | 任一非零 → 置 0xC00 | PPU |

含义 逆向推断:每个功能模块有 2 个中断 bit(G0/G1),硬件可能只置其中一个,但驱动判定完成时需要两个都为 1,因此做归一化。

CNA 寄存器块(Convolution Neural-network Accelerator)

基址:CORE_BASE + 0x1000 | 地址范围:0x1000 ~ 0x1FFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

CNA 是卷积加速单元,包含特征数据加载、权重加载、384KB 内部缓冲(CBUF)、序列扫描控制器(CSC)。

RKNN_cna_s_status(0x1000)

执行器状态寄存器(只读)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:18 | RO | 0x0 | — | 保留 |

| 17:16 | RO | 0x0 | status_1 | 执行器 1 状态。0:空闲;1:正在执行;2:正在执行且执行器 1 等待执行;3:保留 |

| 15:2 | RO | 0x0 | — | 保留 |

| 1:0 | RO | 0x0 | status_0 | 执行器 0 状态。0:空闲;1:正在执行;2:正在执行且执行器 1 等待执行;3:保留 |

RKNN_cna_s_pointer(0x1004)

寄存器组指针与 ping-pong 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16 | RO | 0x0 | executer | 当前使用的寄存器组。0:执行器组 0;1:执行器组 1 |

| 15:6 | RO | 0x0 | — | 保留 |

| 5 | W1C | 0x0 | executer_pp_clear | 清除执行器组指针,写 1 清零 |

| 4 | W1C | 0x0 | pointer_pp_clear | 清除寄存器组指针,写 1 清零 |

| 3 | RW | 0x0 | pointer_pp_mode | Ping-pong 模式。0:按执行器切换(executer 0 完成后切到 1);1:按指针切换(pointer 0 完成后切到 1) |

| 2 | RW | 0x0 | executer_pp_en | 执行器组 ping-pong 使能。0:禁用;1:使能 |

| 1 | RW | 0x0 | pointer_pp_en | 寄存器组 ping-pong 使能。0:禁用;1:使能 |

| 0 | RW | 0x0 | pointer | 当前待设置的寄存器组。0:组 0;1:组 1 |

RKNN_cna_operation_enable(0x1008)

操作使能寄存器。写入此寄存器将触发 CNA 模块开始执行。此寄存器及之后的寄存器均为 ping-pong 影子寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | op_en | CNA 操作使能。0:禁用;1:使能 |

RKNN_cna_conv_con1(0x100C)

卷积控制寄存器 1:精度、模式、反卷积等。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31 | RO | 0x0 | — | 保留 |

| 30 | RW | 0x0 | nonalign_dma | CNA DMA 非对齐模式。0:禁用;1:使能(ARGB 模式下请开启,使 DMA 连续取特征数据) |

| 29 | RW | 0x0 | group_line_off | 组行取数关闭。0:使能组行取数;1:禁用(仅影响取数效率) |

| 28:17 | RO | 0x0 | — | 保留 |

| 16 | RW | 0x0 | deconv | 反卷积使能。0:禁用;1:使能 |

| 15:12 | RW | 0x0 | argb_in | 非对齐通道层控制。8:1 通道输入;9:2 通道;10:3 通道;11:4 通道 |

| 11:10 | RO | 0x0 | — | 保留 |

| 9:7 | RW | 0x0 | proc_precision | 处理精度。0:int8;1:int16;2:fp16;3:bf16;6:int4;7:tf32 |

| 6:4 | RW | 0x0 | in_precision | 输入精度。编码同 proc_precision |

| 3:0 | RW | 0x0 | conv_mode | 卷积模式。0:直接卷积;3:深度可分离卷积(Depthwise) |

RKNN_cna_conv_con2(0x1010)

卷积控制寄存器 2:kernel 分组、feature grain、CSC 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:24 | RO | 0x0 | — | 保留 |

| 23:16 | RW | 0x0 | kernel_group | Kernel 分组数。int8 下 32 个 kernel 为 1 组,int16/fp16 下 16 个为 1 组。例:256 个 kernel,int8 下设为 256/32−1=7 |

| 15:14 | RO | 0x0 | — | 保留 |

| 13:4 | RW | 0x0 | feature_grains | 卷积开始前需缓冲的特征数据行数。建议设为 y_stride + weight_height + 1 |

| 3 | RO | 0x0 | — | 保留 |

| 2 | RW | 0x0 | csc_wo_en | 权重扫描控制。0:使能 CSC 输出权重到 CORE;1:禁用 |

| 1 | RW | 0x0 | csc_do_en | 数据扫描控制。0:使能 CSC 输出特征数据到 CORE;1:禁用 |

| 0 | RW | 0x0 | cmd_fifo_srst | 命令 FIFO 软复位(调试用) |

RKNN_cna_conv_con3(0x1014)

卷积控制寄存器 3:多核模式、空洞卷积、反卷积步长、卷积步长。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31 | RO | 0x0 | — | 保留 |

| 30:28 | RW | 0x0 | nn_mode | 多核协作模式。0:32×32(单核);1:64×32;2:96×32;4:32×64;5:32×96。单核模式保持 0 |

| 27:26 | RO | 0x0 | — | 保留 |

| 25:21 | RW | 0x0 | atrous_y_dilation | 空洞卷积 Y 方向膨胀值(列方向两像素间插入的 pad 数) |

| 20:16 | RW | 0x0 | atrous_x_dilation | 空洞卷积 X 方向膨胀值(行方向两像素间插入的 pad 数)。>0 时启用空洞卷积 |

| 15:14 | RO | 0x0 | — | 保留 |

| 13:11 | RW | 0x0 | deconv_y_stride | 反卷积 Y 步长 |

| 10:8 | RW | 0x0 | deconv_x_stride | 反卷积 X 步长 |

| 7:6 | RO | 0x0 | — | 保留 |

| 5:3 | RW | 0x0 | conv_y_stride | 卷积 Y 步长 |

| 2:0 | RW | 0x0 | conv_x_stride | 卷积 X 步长 |

RKNN_cna_data_size0(0x1020)

输入特征数据宽高。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:27 | RO | 0x0 | — | 保留 |

| 26:16 | RW | 0x0 | datain_width | 输入特征数据宽度 |

| 15:11 | RO | 0x0 | — | 保留 |

| 10:0 | RW | 0x0 | datain_height | 输入特征数据高度 |

RKNN_cna_data_size1(0x1024)

输入特征数据通道数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:30 | RO | 0x0 | — | 保留 |

| 29:16 | RW | 0x0 | datain_channel_real | 真实通道数。当输入通道不是 8(int8)或 4(int16/fp16)的整数倍时,设置此字段 |

| 15:0 | RW | 0x0 | datain_channel | 输入通道数。int8 须为 8 的整数倍;int16/fp16 须为 4 的整数倍 |

RKNN_cna_data_size2(0x1028)

卷积后输出数据宽度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:11 | RO | 0x0 | — | 保留 |

| 10:0 | RW | 0x0 | dataout_width | 卷积后数据宽度 |

RKNN_cna_data_size3(0x102C)

卷积后输出数据 surface 模式与总像素数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:24 | RO | 0x0 | — | 保留 |

| 23:22 | RW | 0x0 | surf_mode | Surface 串行模式。0/1:1 surf;2:2 surf;3:4 surf |

| 21:0 | RW | 0x0 | dataout_atomics | 卷积后输出总像素数 |

RKNN_cna_weight_size0(0x1030)

权重总字节数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | weight_bytes | 本次卷积的权重总字节数 |

RKNN_cna_weight_size1(0x1034)

单个 kernel 的权重字节数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:19 | RO | 0x0 | — | 保留 |

| 18:0 | RW | 0x0 | weight_bytes_per_kernel | 单个 kernel 的权重字节数 |

RKNN_cna_weight_size2(0x1038)

Kernel 宽高与数量。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:29 | RO | 0x0 | — | 保留 |

| 28:24 | RW | 0x0 | weight_width | Kernel 宽度 |

| 23:21 | RO | 0x0 | — | 保留 |

| 20:16 | RW | 0x0 | weight_height | Kernel 高度 |

| 15:14 | RO | 0x0 | — | 保留 |

| 13:0 | RW | 0x0 | weight_kernels | Kernel 数量 |

RKNN_cna_cbuf_con0(0x1040)

CBUF(内部缓冲)控制寄存器 0:数据/权重复用、Bank 分配。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:14 | RO | 0x0 | — | 保留 |

| 13 | RW | 0x0 | weight_reuse | 权重数据复用使能。0:禁用;1:使能,直接从内部缓冲取权重 |

| 12 | RW | 0x0 | data_reuse | 特征数据复用使能。0:禁用;1:使能,直接从内部缓冲取数据 |

| 11 | RO | 0x0 | — | 保留 |

| 10:8 | RW | 0x0 | fc_data_bank | FC 零跳过模式的特征数据 Bank 数。FC 零跳过模式设为 1,否则必须为 0 |

| 7:4 | RW | 0x0 | weight_bank | 权重数据占用的 Bank 数。1:Bank 7;2:Bank 6-7;…;7:Bank 1-7 |

| 3:0 | RW | 0x0 | data_bank | 特征数据占用的 Bank 数。0:Bank 0;1:Bank 0-1;…;6:Bank 0-6 |

RKNN_cna_cbuf_con1(0x1044)

CBUF 控制寄存器 1。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | data_entries | 存储一行特征图所需的 Bank 空间 |

RKNN_cna_cvt_con0(0x104C)

输入转换控制寄存器 0:CVT 截断值、符号、舍入、旁路。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:28 | RO | 0x0 | — | 保留 |

| 27:22 | RW | 0x0 | cvt_truncate_3 | CVT 截断值 3 |

| 21:16 | RW | 0x0 | cvt_truncate_2 | CVT 截断值 2 |

| 15:10 | RW | 0x0 | cvt_truncate_1 | CVT 截断值 1 |

| 9:4 | RW | 0x0 | cvt_truncate_0 | CVT 截断值 0 |

| 3 | RW | 0x0 | data_sign | 特征数据符号。0:无符号;1:有符号 |

| 2 | RW | 0x0 | round_type | 舍入类型。0:奇入偶不入;1:0.5 向上进 1 |

| 1 | RW | 0x0 | cvt_type | 转换运算顺序。0:先乘后加;1:先加后乘 |

| 0 | RW | 0x0 | cvt_bypass | 旁路输入转换。0:使能 CVT;1:禁用 CVT |

RKNN_cna_cvt_con1(0x1050)

输入转换控制 1:第 1 通道的 scale 和 offset。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | cvt_scale0 | CVT 缩放 0(第 1 通道乘法操作数) |

| 15:0 | RW | 0x0 | cvt_offset0 | CVT 偏移 0(第 1 通道加法操作数) |

RKNN_cna_cvt_con2(0x1054)

输入转换控制 2:第 2 通道。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | cvt_scale1 | CVT 缩放 1(第 2 通道乘法操作数) |

| 15:0 | RW | 0x0 | cvt_offset1 | CVT 偏移 1(第 2 通道加法操作数) |

RKNN_cna_cvt_con3(0x1058)

输入转换控制 3:第 3 通道。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | cvt_scale2 | CVT 缩放 2(第 3 通道乘法操作数) |

| 15:0 | RW | 0x0 | cvt_offset2 | CVT 偏移 2(第 3 通道加法操作数) |

RKNN_cna_cvt_con4(0x105C)

输入转换控制 4:第 4 通道。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | cvt_scale3 | CVT 缩放 3(第 4 通道乘法操作数) |

| 15:0 | RW | 0x0 | cvt_offset3 | CVT 偏移 3(第 4 通道加法操作数) |

RKNN_cna_fc_con0(0x1060)

全连接零跳过控制 0。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | fc_skip_data | FC 零跳过数据值(通常设为 0) |

| 15:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | fc_skip_en | FC 零跳过使能。0:禁用;1:使能。当某像素特征数据为 0 时,跳过对应权重的取数 |

RKNN_cna_fc_con1(0x1064)

全连接零跳过控制 1。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16:0 | RW | 0x0 | data_offset | FC 零跳过模式下的特征数据偏移 |

RKNN_cna_pad_con0(0x1068)

Pad 控制寄存器 0。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:8 | RO | 0x0 | — | 保留 |

| 7:4 | RW | 0x0 | pad_left | 特征图左侧 pad 数 |

| 3:0 | RW | 0x0 | pad_top | 特征图顶部 pad 数 |

RKNN_cna_feature_data_addr(0x1070)

输入特征数据基址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | feature_base_addr | 特征数据地址 |

RKNN_cna_fc_con2(0x1074)

权重数据地址偏移。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16:0 | RW | 0x0 | weight_offset | 权重数据地址偏移 |

RKNN_cna_dma_con0(0x1078)

AXI DMA 控制寄存器 0:burst 长度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31 | RW | 0x0 | ov4k_bypass | 超 4K burst 拆分。0:使能(将超 4K 的 burst 拆为 2 个);1:旁路 |

| 30:20 | RO | 0x0 | — | 保留 |

| 19:16 | RW | 0x0 | weight_burst_len | 权重 DMA AXI burst 长度。3:burst=4;7:burst=8;15:burst=16 |

| 15:4 | RO | 0x0 | — | 保留 |

| 3:0 | RW | 0x0 | data_burst_len | 特征 DMA AXI burst 长度。编码同上 |

RKNN_cna_dma_con1(0x107C)

行步长(Line stride)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:28 | RO | 0x0 | — | 保留 |

| 27:0 | RW | 0x0 | line_stride | 行步长。含虚拟框(Virtual box)的特征宽度 |

RKNN_cna_dma_con2(0x1080)

Surface 步长。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:28 | RO | 0x0 | — | 保留 |

| 27:0 | RW | 0x0 | surf_stride | Surface 步长。特征图实际 surface 面积 |

RKNN_cna_fc_data_size0(0x1084)

FC 模式下 AXI DMA 的特征输入宽高。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:30 | RO | 0x0 | — | 保留 |

| 29:16 | RW | 0x0 | dma_width | AXI DMA 特征输入宽度 |

| 15:11 | RO | 0x0 | — | 保留 |

| 10:0 | RW | 0x0 | dma_height | AXI DMA 特征输入高度 |

RKNN_cna_fc_data_size1(0x1088)

FC 模式下 AXI DMA 的特征输入通道数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:0 | RW | 0x0 | dma_channel | AXI DMA 特征输入通道数 |

RKNN_cna_clk_gate(0x1090)

时钟门控控制寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:5 | RO | 0x0 | — | 保留 |

| 4 | RW | 0x0 | cbuf_cs_disable_clkgate | CBUF 自动时钟门控。0:使能自动门控;1:禁用 CBUF 时钟门控 |

| 3 | RO | 0x0 | — | 保留 |

| 2 | RW | 0x0 | csc_disable_clkgate | CSC 自动时钟门控。0:使能;1:禁用 CSC 时钟门控 |

| 1 | RW | 0x0 | cna_weight_disable_clkgate | 权重取数自动时钟门控。0:使能;1:禁用 |

| 0 | RW | 0x0 | cna_feature_disable_clkgate | 特征取数自动时钟门控。0:使能;1:禁用 |

RKNN_cna_dcomp_ctrl(0x1100)

权重解压控制寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RO | 0x0 | — | 保留 |

| 3 | RW | 0x0 | wt_dec_bypass | 旁路权重解压 |

| 2:0 | RW | 0x0 | decomp_control | 权重解压控制 |

RKNN_cna_dcomp_regnum(0x1104)

权重解压寄存器数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | dcomp_regnum | 权重解压寄存器数量 |

RKNN_cna_dcomp_addr0(0x1110)

权重基址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | decompress_addr0 | 权重基址 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_cna_dcomp_amount0~15(0x1140 ~ 0x117C)

权重解压量寄存器,共 16 个,偏移 0x1140 + N×4(N = 0~15)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | dcomp_amountN | 第 N 次解压的权重数据量 |

RKNN_cna_cvt_con5(0x1180)

按通道 CVT 使能。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | per_channel_cvt_en | 按通道使能 CVT 功能。int4 共 32 通道(128 bit),int8 共 16 通道 |

RKNN_cna_pad_con1(0x1184)

Pad 值寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | pad_value | Pad 填充值 |

CORE 寄存器块(MAC 核心控制)

基址:CORE_BASE + 0x3000 | 地址范围:0x3000 ~ 0x3FFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

CORE 模块包含 MAC 阵列和累加器,负责卷积乘累加运算。

RKNN_core_s_status(0x3000)

执行器状态寄存器(只读)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:18 | RO | 0x0 | — | 保留 |

| 17:16 | RO | 0x0 | status_1 | 执行器 1 状态。0:空闲;1:正在执行;2:正在执行且执行器 1 等待执行;3:保留 |

| 15:2 | RO | 0x0 | — | 保留 |

| 1:0 | RO | 0x0 | status_0 | 执行器 0 状态。编码同 status_1 |

RKNN_core_s_pointer(0x3004)

寄存器组指针与 ping-pong 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16 | RO | 0x0 | executer | 当前使用的寄存器组。0:执行器组 0;1:执行器组 1 |

| 15:6 | RO | 0x0 | — | 保留 |

| 5 | W1C | 0x0 | executer_pp_clear | 清除执行器组指针,写 1 清零 |

| 4 | W1C | 0x0 | pointer_pp_clear | 清除寄存器组指针,写 1 清零 |

| 3 | RW | 0x0 | pointer_pp_mode | Ping-pong 模式。0:按执行器切换;1:按指针切换 |

| 2 | RW | 0x0 | executer_pp_en | 执行器组 ping-pong 使能。0:禁用;1:使能 |

| 1 | RW | 0x0 | pointer_pp_en | 寄存器组 ping-pong 使能。0:禁用;1:使能 |

| 0 | RW | 0x0 | pointer | 当前待设置的寄存器组。0:组 0;1:组 1 |

RKNN_core_operation_enable(0x3008)

操作使能寄存器。写入此寄存器将触发 CORE 模块开始执行。此寄存器及之后的寄存器均为 ping-pong 影子寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | op_en | CORE 操作使能。0:禁用;1:使能 |

RKNN_core_mac_gating(0x300C)

MAC 软时钟门控寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:27 | RO | 0x0 | — | 保留 |

| 26:0 | RW | 0x7800800 | slcg_op_en | 软时钟门控信号 |

注意:复位值为

0x07800800,与其他寄存器不同。

RKNN_core_misc_cfg(0x3010)

杂项配置寄存器:精度、深度可分离、量化使能。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:20 | RO | 0x0 | — | 保留 |

| 19:14 | RW | 0x0 | soft_gating | 累加器软门控信号 |

| 13:11 | RO | 0x0 | — | 保留 |

| 10:8 | RW | 0x0 | proc_precision | 处理精度。0:int8;1:int16;2:fp16;3:bf16;6:int4;7:tf32 |

| 7:2 | RO | 0x0 | — | 保留 |

| 1 | RW | 0x0 | dw_en | 深度可分离模式使能。0:禁用;1:使能 Depthwise 模式 |

| 0 | RW | 0x0 | qd_en | 量化特征数据计算使能。0:禁用;1:使能 |

RKNN_core_dataout_size_0(0x3014)

输出特征尺寸寄存器 0:宽高。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | dataout_height | 激活后输出数据高度 |

| 15:0 | RW | 0x0 | dataout_width | 激活后输出数据宽度 |

RKNN_core_dataout_size_1(0x3018)

输出特征尺寸寄存器 1:通道数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:0 | RW | 0x0 | dataout_channel | 激活后输出数据通道数 |

RKNN_core_clip_truncate(0x301C)

截断与舍入控制寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:7 | RO | 0x0 | — | 保留 |

| 6 | RW | 0x0 | round_type | 舍入类型。0:奇入偶不入;1:0.5 向上进 1 |

| 5 | RO | 0x0 | — | 保留 |

| 4:0 | RW | 0x0 | clip_truncate | 截断位数 |

DPU 寄存器块(Data Processing Unit)

基址:CORE_BASE + 0x4000 | 地址范围:0x4000 ~ 0x4FFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

DPU 负责后处理运算,包含三级流水线核心:BS CORE(Bias/Scale)→ BN CORE(Batch Norm)→ EW CORE(Element-Wise),以及输出转换器、LUT 引擎、转置/重组等功能。

RKNN_dpu_s_status(0x4000)

执行器状态寄存器(只读)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:18 | RO | 0x0 | — | 保留 |

| 17:16 | RO | 0x0 | status_1 | 执行器 1 状态。0:空闲;1:正在执行;2:正在执行且等待执行;3:保留 |

| 15:2 | RO | 0x0 | — | 保留 |

| 1:0 | RO | 0x0 | status_0 | 执行器 0 状态。编码同 status_1 |

RKNN_dpu_s_pointer(0x4004)

寄存器组指针与 ping-pong 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16 | RO | 0x0 | executer | 当前使用的寄存器组。0:组 0;1:组 1 |

| 15:6 | RO | 0x0 | — | 保留 |

| 5 | W1C | 0x0 | executer_pp_clear | 清除执行器组指针,写 1 清零 |

| 4 | W1C | 0x0 | pointer_pp_clear | 清除寄存器组指针,写 1 清零 |

| 3 | RW | 0x0 | pointer_pp_mode | Ping-pong 模式。0:按执行器切换;1:按指针切换 |

| 2 | RW | 0x0 | executer_pp_en | 执行器组 ping-pong 使能 |

| 1 | RW | 0x0 | pointer_pp_en | 寄存器组 ping-pong 使能 |

| 0 | RW | 0x0 | pointer | 当前待设置的寄存器组。0:组 0;1:组 1 |

RKNN_dpu_operation_enable(0x4008)

操作使能。写入触发 DPU 执行,此寄存器及之后均为 ping-pong 影子寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | op_en | DPU 操作使能。0:禁用;1:使能 |

RKNN_dpu_feature_mode_cfg(0x400C)

特征模式配置:flying mode、输出目标、卷积模式、burst、非对齐、转置、重组。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31 | RW | 0x0 | comb_use | 组合使用,同 DPU_RDMA comb_use[0] |

| 30 | RW | 0x0 | tp_en | 转置使能 |

| 29:26 | RW | 0x0 | rgp_type | 重组类型。0:全部 128bit;1:4bit;2:8bit;3:16bit;4:32bit;5:64bit |

| 25 | RW | 0x0 | nonalign | 非对齐模式使能(输出数据流与输入相同时可用) |

| 24:9 | RW | 0x0 | surf_len | 非对齐模式下存储的 8 字节数 |

| 8:5 | RW | 0x0 | burst_len | Burst 长度。3:Burst4;7:Burst8;15:Burst16 |

| 4:3 | RW | 0x0 | conv_mode | 卷积模式。0:普通卷积;3:Depthwise |

| 2:1 | RW | 0x0 | output_mode | 输出目标。[0]:输出到 PPU;[1]:输出到外部 |

| 0 | RW | 0x0 | flying_mode | Flying 模式。0:主数据来自卷积输出;1:主数据来自 MRDMA |

RKNN_dpu_data_format(0x4010)

数据格式配置:输入/输出/处理精度、负数移位值。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:29 | RW | 0x0 | out_precision | 输出精度。0:int8;1:int16;2:fp16;3:bf16;4:int32;5:fp32;6:int4 |

| 28:26 | RW | 0x0 | in_precision | 输入精度(同 DPU_RDMA)。编码同上 |

| 25:16 | RW | 0x0 | ew_truncate_neg | EW CORE 负数移位值 |

| 15:10 | RW | 0x0 | bn_mul_shift_value_neg | BN CORE 负数移位值 |

| 9:4 | RW | 0x0 | bs_mul_shift_value_neg | BS CORE 负数移位值 |

| 3 | RW | 0x0 | mc_surf_out | 多 surface 输出。0:每像素 16 字节对齐;1:可输出 2/4 surface 串行 |

| 2:0 | RW | 0x0 | proc_precision | 处理精度。编码同 out_precision |

RKNN_dpu_offset_pend(0x4014)

额外通道填充值。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:0 | RW | 0x0 | offset_pend | 额外通道设置值 |

RKNN_dpu_dst_base_addr(0x4020)

目标基址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | dst_base_addr | 目标基址 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_dpu_dst_surf_stride(0x4024)

输出 surface 步长。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | dst_surf_stride | 输出 shape 的 surface 步长 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_dpu_data_cube_width(0x4030)

输入 cube 宽度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | width | 输入 cube 宽度 |

RKNN_dpu_data_cube_height(0x4034)

输入 cube 高度 + minmax 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:25 | RO | 0x0 | — | 保留 |

| 24:22 | RW | 0x0 | minmax_ctl | MinMax 配置。[0]:使能;[1]:类型;[2]:仅概率 |

| 21:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | height | 输入 cube 高度 |

RKNN_dpu_data_cube_notch_addr(0x4038)

Notch 地址(宽度末尾到 shape 行末的像素数)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:29 | RO | 0x0 | — | 保留 |

| 28:16 | RW | 0x0 | notch_addr_1 | Notch 地址 1 |

| 15:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | notch_addr_0 | Notch 地址 0 |

RKNN_dpu_data_cube_channel(0x403C)

输入 cube 通道数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:29 | RO | 0x0 | — | 保留 |

| 28:16 | RW | 0x0 | orig_channel | 原始输出通道数 |

| 15:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | channel | Cube 通道数 |

RKNN_dpu_bs_cfg(0x4040)

BS CORE 配置:ALU 算法、操作数来源、ReLU/PRELU/RELUX 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:20 | RO | 0x0 | — | 保留 |

| 19:16 | RW | 0x0 | bs_alu_algo | BS ALU 运算类型。2:Add;4:Minus |

| 15:9 | RO | 0x0 | — | 保留 |

| 8 | RW | 0x0 | bs_alu_src | ALU 操作数来源。0:寄存器;1:外部 |

| 7 | RW | 0x0 | bs_relux_en | RELUX 使能 |

| 6 | RW | 0x0 | bs_relu_bypass | 旁路 BS RELU。0:不旁路;1:旁路 |

| 5 | RW | 0x0 | bs_mul_prelu | MUL PRELU 使能 |

| 4 | RW | 0x0 | bs_mul_bypass | 旁路 BS MUL |

| 3:2 | RO | 0x0 | — | 保留 |

| 1 | RW | 0x0 | bs_alu_bypass | 旁路 BS ALU |

| 0 | RW | 0x0 | bs_bypass | 旁路整个 BS CORE |

RKNN_dpu_bs_alu_cfg(0x4044)

BS ALU 操作数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | bs_alu_operand | BS CORE ALU 操作数 |

RKNN_dpu_bs_mul_cfg(0x4048)

BS MUL 配置:操作数、移位值、来源。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | bs_mul_operand | BS MUL 操作数 |

| 15:14 | RO | 0x0 | — | 保留 |

| 13:8 | RW | 0x0 | bs_mul_shift_value | BS 正数移位值 |

| 7:2 | RO | 0x0 | — | 保留 |

| 1 | RW | 0x0 | bs_truncate_src | 移位值来源。0:寄存器;1:外部 |

| 0 | RW | 0x0 | bs_mul_src | MUL 操作数来源。0:寄存器;1:外部 |

RKNN_dpu_bs_relux_cmp_value(0x404C)

BS RELUX 比较值。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | bs_relux_cmp_dat | RELUX 比较值 |

RKNN_dpu_bs_ow_cfg(0x4050)

BS OW(CPEND)配置 + 重组计数器 + 转置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:28 | RW | 0x0 | rgp_cnter | 重组计数器。0:全选;1:每 2 选 1;2:每 4 选 1;3:每 8 选 1 |

| 27 | RW | 0x0 | tp_org_en | 原始转置使能 |

| 26:11 | RO | 0x0 | — | 保留 |

| 10:8 | RW | 0x0 | size_e_2 | 最后一行输出每行 8 通道数(−1) |

| 7:5 | RW | 0x0 | size_e_1 | 中间行输出每行 8 通道数(−1) |

| 4:2 | RW | 0x0 | size_e_0 | 第一行输出每行 8 通道数(−1) |

| 1 | RW | 0x0 | od_bypass | 旁路 CPEND |

| 0 | RW | 0x0 | ow_src | CPEND 操作数来源。0:寄存器;1:外部 |

RKNN_dpu_bs_ow_op(0x4054)

CPEND 操作数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:0 | RW | 0x0 | ow_op | CPEND 操作数 |

RKNN_dpu_wdma_size_0(0x4058)

DPU WDMA 尺寸 0:转置精度、通道。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:28 | RO | 0x0 | — | 保留 |

| 27 | RW | 0x0 | tp_precision | 转置精度。0:8bit;1:16bit |

| 26:16 | RW | 0x0 | size_c_wdma | WDMA 的 size_c |

| 15:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | channel_wdma | WDMA 通道数 |

RKNN_dpu_wdma_size_1(0x405C)

DPU WDMA 尺寸 1:宽高。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:29 | RO | 0x0 | — | 保留 |

| 28:16 | RW | 0x0 | height_wdma | WDMA 高度 |

| 15:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | width_wdma | WDMA 宽度 |

RKNN_dpu_bn_cfg(0x4060)

BN CORE 配置:ALU 算法、操作数来源、ReLU/PRELU/RELUX 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:20 | RO | 0x0 | — | 保留 |

| 19:16 | RW | 0x0 | bn_alu_algo | BN ALU 运算类型。2:Add;4:Minus |

| 15:9 | RO | 0x0 | — | 保留 |

| 8 | RW | 0x0 | bn_alu_src | ALU 操作数来源。0:寄存器;1:外部 |

| 7 | RW | 0x0 | bn_relux_en | RELUX 使能 |

| 6 | RW | 0x0 | bn_relu_bypass | 旁路 BN RELU |

| 5 | RW | 0x0 | bn_mul_prelu | MUL PRELU 使能 |

| 4 | RW | 0x0 | bn_mul_bypass | 旁路 BN MUL |

| 3:2 | RO | 0x0 | — | 保留 |

| 1 | RW | 0x0 | bn_alu_bypass | 旁路 BN ALU |

| 0 | RW | 0x0 | bn_bypass | 旁路整个 BN CORE |

RKNN_dpu_bn_alu_cfg(0x4064)

BN ALU 操作数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | bn_alu_operand | BN CORE ALU 操作数 |

RKNN_dpu_bn_mul_cfg(0x4068)

BN MUL 配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | bn_mul_operand | BN MUL 操作数 |

| 15:14 | RO | 0x0 | — | 保留 |

| 13:8 | RW | 0x0 | bn_mul_shift_value | BN 正数移位值 |

| 7:2 | RO | 0x0 | — | 保留 |

| 1 | RW | 0x0 | bn_truncate_src | 移位值来源。0:寄存器;1:外部 |

| 0 | RW | 0x0 | bn_mul_src | MUL 操作数来源。0:寄存器;1:外部 |

RKNN_dpu_bn_relux_cmp_value(0x406C)

BN RELUX 比较值。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | bn_relux_cmp_dat | BN RELUX 比较数据 |

RKNN_dpu_ew_cfg(0x4070)

EW CORE 配置:ALU 算法(Max/Min/Add/Div/Minus/Abs/Neg/Floor/Ceil)、LUT、转换器、PRELU 等。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31 | RW | 0x0 | ew_cvt_type | EW 输入转换类型。0:先乘后加;1:先加后乘 |

| 30 | RW | 0x0 | ew_cvt_round | EW 输入转换舍入。0:奇入偶不入;1:0.5 向上进 1 |

| 29:28 | RW | 0x0 | ew_data_mode | ERDMA 数据模式 |

| 27:24 | RO | 0x0 | — | 保留 |

| 23:22 | RW | 0x0 | edata_size | ERDMA cube 数据大小。0:4bit;1:8bit;2:16bit;3:32bit |

| 21 | RW | 0x0 | ew_equal_en | MinMax 相等使能 |

| 20 | RW | 0x0 | ew_binary_en | MinMax 二值使能 |

| 19:16 | RW | 0x0 | ew_alu_algo | EW ALU 运算。0:Max;1:Min;2:Add;3:Div;4:Minus;5:Abs;6:Neg;7:Floor;8:Ceil |

| 15:11 | RO | 0x0 | — | 保留 |

| 10 | RW | 0x0 | ew_relux_en | RELUX 使能 |

| 9 | RW | 0x0 | ew_relu_bypass | 旁路 EW RELU |

| 8 | RW | 0x0 | ew_op_cvt_bypass | 旁路 EW 输入转换器 |

| 7 | RW | 0x0 | ew_lut_bypass | 旁路 LUT |

| 6 | RW | 0x0 | ew_op_src | 操作数来源。0:寄存器;1:外部 |

| 5 | RW | 0x0 | ew_mul_prelu | MUL PRELU 使能 |

| 4:3 | RO | 0x0 | — | 保留 |

| 2 | RW | 0x0 | ew_op_type | 运算类型。0:ALU;1:MUL |

| 1 | RW | 0x0 | ew_op_bypass | 旁路 EW ALU 和 MUL |

| 0 | RW | 0x0 | ew_bypass | 旁路整个 EW CORE |

RKNN_dpu_ew_cvt_offset_value(0x4074)

EW 输入转换偏移。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | ew_op_cvt_offset | EW 转换偏移 |

RKNN_dpu_ew_cvt_scale_value(0x4078)

EW 转换缩放与移位。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:22 | RW | 0x0 | ew_truncate | EW CORE 移位值 |

| 21:16 | RW | 0x0 | ew_op_cvt_shift | EW 转换移位值 |

| 15:0 | RW | 0x0 | ew_op_cvt_scale | EW 转换缩放 |

RKNN_dpu_ew_relux_cmp_value(0x407C)

EW RELUX 比较值。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | ew_relux_cmp_dat | EW RELUX 比较数据 |

RKNN_dpu_out_cvt_offset(0x4080)

输出转换偏移。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | out_cvt_offset | 输出转换器偏移 |

RKNN_dpu_out_cvt_scale(0x4084)

输出转换缩放 + fp32→fp16 使能。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16 | RW | 0x0 | fp32tofp16_en | 使能输出 fp32→fp16 转换 |

| 15:0 | RW | 0x0 | out_cvt_scale | 输出转换器缩放 |

RKNN_dpu_out_cvt_shift(0x4088)

输出转换移位、舍入、指数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31 | RW | 0x0 | cvt_type | 输出转换类型。0:先乘后加;1:先加后乘 |

| 30 | RW | 0x0 | cvt_round | 输出转换舍入。0:奇入偶不入;1:0.5 向上进 1 |

| 29:20 | RO | 0x0 | — | 保留 |

| 19:12 | RW | 0x0 | minus_exp | 输出 CVT 减指数 |

| 11:0 | RW | 0x0 | out_cvt_shift | 输出转换器移位 |

RKNN_dpu_ew_op_value_0~7(0x4090 ~ 0x40AC)

EW CORE 操作数寄存器,共 8 个,偏移 0x4090 + N×4(N = 0~7)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | ew_operand_N | 第 N+1 个 EW 操作数 |

RKNN_dpu_surface_add(0x40C0)

Surface 加法器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | surf_add | 一行中有多少个 surface |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_dpu_lut_access_cfg(0x4100)

LUT 访问配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:18 | RO | 0x0 | — | 保留 |

| 17 | RW | 0x0 | lut_access_type | 访问类型。0:读;1:写 |

| 16 | RW | 0x0 | lut_table_id | 访问 ID。0:LE LUT;1:LO LUT |

| 15:10 | RO | 0x0 | — | 保留 |

| 9:0 | RW | 0x0 | lut_addr | 访问地址 |

RKNN_dpu_lut_access_data(0x4104)

LUT 访问数据。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:0 | RW | 0x0 | lut_access_data | LUT 访问数据 |

RKNN_dpu_lut_cfg(0x4108)

LUT 配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:8 | RO | 0x0 | — | 保留 |

| 7 | RW | 0x0 | lut_cal_sel | LUT 计算选择(仅 lut_expand_en=1 时有效) |

| 6 | RW | 0x0 | lut_hybrid_priority | 混合流优先级。0:LE LUT;1:LO LUT |

| 5 | RW | 0x0 | lut_oflow_priority | 上溢优先级。0:LE;1:LO |

| 4 | RW | 0x0 | lut_uflow_priority | 下溢优先级。0:LE;1:LO |

| 3:2 | RW | 0x0 | lut_lo_le_mux | LO/LE LUT 复用 |

| 1 | RW | 0x0 | lut_expand_en | 扩展两个小 LUT 为一个大 LUT |

| 0 | RW | 0x0 | lut_road_sel | LUT 路径选择。0:第 1 路;1:第 2 路 |

RKNN_dpu_lut_info(0x410C)

LUT 索引选择。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:24 | RO | 0x0 | — | 保留 |

| 23:16 | RW | 0x0 | lut_lo_index_select | LO LUT 索引选择(索引生成器中选择哪些位作为索引) |

| 15:8 | RW | 0x0 | lut_le_index_select | LE LUT 索引选择 |

| 7:0 | RO | 0x0 | — | 保留 |

RKNN_dpu_lut_le_start(0x4110)

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | lut_le_start | LE LUT 起始点 |

RKNN_dpu_lut_le_end(0x4114)

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | lut_le_end | LE LUT 终止点 |

RKNN_dpu_lut_lo_start(0x4118)

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | lut_lo_start | LO LUT 起始点 |

RKNN_dpu_lut_lo_end(0x411C)

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | lut_lo_end | LO LUT 终止点 |

RKNN_dpu_lut_le_slope_scale(0x4120)

LE LUT 斜率缩放(上溢/下溢)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | lut_le_slope_oflow_scale | LE LUT 上溢斜率缩放 |

| 15:0 | RW | 0x0 | lut_le_slope_uflow_scale | LE LUT 下溢斜率缩放 |

RKNN_dpu_lut_le_slope_shift(0x4124)

LE LUT 斜率移位。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:10 | RO | 0x0 | — | 保留 |

| 9:5 | RW | 0x0 | lut_le_slope_oflow_shift | LE LUT 上溢斜率移位 |

| 4:0 | RW | 0x0 | lut_le_slope_uflow_shift | LE LUT 下溢斜率移位 |

RKNN_dpu_lut_lo_slope_scale(0x4128)

LO LUT 斜率缩放。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | lut_lo_slope_oflow_scale | LO LUT 上溢斜率缩放 |

| 15:0 | RW | 0x0 | lut_lo_slope_uflow_scale | LO LUT 下溢斜率缩放 |

RKNN_dpu_lut_lo_slope_shift(0x412C)

LO LUT 斜率移位。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:10 | RO | 0x0 | — | 保留 |

| 9:5 | RW | 0x0 | lut_lo_slope_oflow_shift | LO LUT 上溢斜率移位 |

| 4:0 | RW | 0x0 | lut_lo_slope_uflow_shift | LO LUT 下溢斜率移位 |

DPU_RDMA 寄存器块

基址:CORE_BASE + 0x5000 | 地址范围:0x5000 ~ 0x5FFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

DPU_RDMA 负责为 DPU 从外部内存读取输入数据,包含四路 DMA 引擎:MRDMA(主数据)、BRDMA(BS 操作数)、NRDMA(BN 操作数)、ERDMA(EW 操作数)。

RKNN_dpu_rdma_s_status(0x5000)

执行器状态寄存器(只读)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:18 | RO | 0x0 | — | 保留 |

| 17:16 | RO | 0x0 | status_1 | 执行器 1 状态。0:空闲;1:正在执行;2:正在执行且等待执行;3:保留 |

| 15:2 | RO | 0x0 | — | 保留 |

| 1:0 | RO | 0x0 | status_0 | 执行器 0 状态。编码同 status_1 |

RKNN_dpu_rdma_s_pointer(0x5004)

寄存器组指针与 ping-pong 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16 | RO | 0x0 | executer | 当前使用的寄存器组。0:组 0;1:组 1 |

| 15:6 | RO | 0x0 | — | 保留 |

| 5 | W1C | 0x0 | executer_pp_clear | 清除执行器组指针,写 1 清零 |

| 4 | W1C | 0x0 | pointer_pp_clear | 清除寄存器组指针,写 1 清零 |

| 3 | RW | 0x0 | pointer_pp_mode | Ping-pong 模式。0:按执行器切换;1:按指针切换 |

| 2 | RW | 0x0 | executer_pp_en | 执行器组 ping-pong 使能 |

| 1 | RW | 0x0 | pointer_pp_en | 寄存器组 ping-pong 使能 |

| 0 | RW | 0x0 | pointer | 当前待设置的寄存器组。0:组 0;1:组 1 |

RKNN_dpu_rdma_operation_enable(0x5008)

操作使能。写入触发 DPU_RDMA 执行,此寄存器及之后均为 ping-pong 影子寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | op_en | DPU_RDMA 操作使能。0:禁用;1:使能 |

RKNN_dpu_rdma_data_cube_width(0x500C)

输入特征宽度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | width | 输入特征宽度(需减 1) |

RKNN_dpu_rdma_data_cube_height(0x5010)

输入特征高度 + EW line notch。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:29 | RO | 0x0 | — | 保留 |

| 28:16 | RW | 0x0 | ew_line_notch_addr | EW 行 notch |

| 15:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | height | 输入特征高度(需减 1) |

RKNN_dpu_rdma_data_cube_channel(0x5014)

输入特征通道数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | channel | 输入特征通道数(需减 1) |

RKNN_dpu_rdma_src_base_addr(0x5018)

Flying 模式源地址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | src_base_addr | Flying 模式源地址 |

RKNN_dpu_rdma_brdma_cfg(0x501C)

BRDMA(BS 操作数读取 DMA)配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:5 | RO | 0x0 | — | 保留 |

| 4:1 | RW | 0x0 | brdma_data_use | 读取数据类型。[0]:ALU 操作数;[1]:CPEND 操作数;[2]:MUL 操作数;[3]:TRT 操作数 |

| 0 | RO | 0x0 | — | 保留 |

RKNN_dpu_rdma_bs_base_addr(0x5020)

BS 操作数基址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | bs_base_addr | 读取 BS ALU、BS CPEND、BS MUL 操作数的基址 |

RKNN_dpu_rdma_nrdma_cfg(0x5028)

NRDMA(BN 操作数读取 DMA)配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:5 | RO | 0x0 | — | 保留 |

| 4:1 | RW | 0x0 | nrdma_data_use | 读取数据类型。[0]:ALU 操作数;[1]:CPEND 操作数(固定为 0,BN 无 CPEND);[2]:MUL 操作数;[3]:TRT 操作数 |

| 0 | RO | 0x0 | — | 保留 |

RKNN_dpu_rdma_bn_base_addr(0x502C)

BN 操作数基址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | bn_base_addr | 读取 BN ALU、BN MUL 操作数的基址 |

RKNN_dpu_rdma_erdma_cfg(0x5034)

ERDMA(EW 操作数读取 DMA)配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:30 | RW | 0x0 | erdma_data_mode | 数据模式。0:按通道;1:按像素;2:按通道×像素;3:保留 |

| 29 | RW | 0x0 | erdma_surf_mode | Surface 模式。0:1 surface 串行;1:2 surface 串行 |

| 28 | RW | 0x0 | erdma_nonalign | 非对齐模式。0:禁用;1:使能 |

| 27:4 | RO | 0x0 | — | 保留 |

| 3:2 | RW | 0x0 | erdma_data_size | ERDMA 读取精度。0:4bit;1:8bit;2:16bit;3:32bit |

| 1 | RW | 0x0 | ov4k_bypass | 超 4K burst 拆分。0:使能;1:旁路 |

| 0 | RW | 0x0 | erdma_disable | 禁用 ERDMA。0:不禁用;1:禁用 |

RKNN_dpu_rdma_ew_base_addr(0x5038)

EW 操作数基址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | ew_base_addr | 读取 EW 操作数的基址 |

RKNN_dpu_rdma_ew_surf_stride(0x5040)

EW 特征图 surface 步长。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | ew_surf_stride | EW 特征图 surface 步长。若 erdma_data_mode 为按通道模式,需设为 1 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_dpu_rdma_feature_mode_cfg(0x5044)

特征模式配置:精度、burst、组合使用、flying mode、unpooling。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:18 | RO | 0x0 | — | 保留 |

| 17:15 | RW | 0x0 | in_precision | 输入数据精度。0:int8;1:int16;2:fp16;3:bf16;4:int32;5:fp32;6:int4 |

| 14:11 | RW | 0x0 | burst_len | Burst 长度。3:Burst4;7:Burst8;15:Burst16 |

| 10:8 | RW | 0x0 | comb_use | 组合使用。[0]:MRDMA 和 ERDMA 读同一数据;[1]:数据送 MRDMA;[2]:数据送 ERDMA |

| 7:5 | RW | 0x0 | proc_precision | 处理精度。编码同 in_precision |

| 4 | RW | 0x0 | mrdma_disable | 禁用 MRDMA。0:不禁用;1:禁用 |

| 3 | RW | 0x0 | mrdma_fp16tofp32_en | 使能 DPU 输入 fp16→fp32 转换 |

| 2:1 | RW | 0x0 | conv_mode | 卷积模式。0:DC;3:Depthwise |

| 0 | RW | 0x0 | flying_mode | Flying 模式。0:主数据来自卷积输出;1:主数据来自 MRDMA |

RKNN_dpu_rdma_src_dma_cfg(0x5048)

源 DMA 配置:line notch、unpooling 参数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:19 | RW | 0x0 | line_notch_addr | 宽度末尾到 shape 特征行末的像素数 |

| 18:14 | RO | 0x0 | — | 保留 |

| 13 | RW | 0x0 | pooling_method | 池化方法。0:平均池化(上采样可用此模式);1:最小/最大池化 |

| 12 | RW | 0x0 | unpooling_en | 反池化使能 |

| 11:9 | RW | 0x0 | kernel_stride_height | 反池化 kernel 步长高度(−1) |

| 8:6 | RW | 0x0 | kernel_stride_width | 反池化 kernel 步长宽度(−1) |

| 5:3 | RW | 0x0 | kernel_height | 反池化 kernel 高度(−1) |

| 2:0 | RW | 0x0 | kernel_width | 反池化 kernel 宽度(−1) |

RKNN_dpu_rdma_surf_notch(0x504C)

Surface notch。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | surf_notch_addr | 当前处理特征图末尾到 shape 特征图末尾的像素数 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_dpu_rdma_pad_cfg(0x5064)

反池化 Pad 配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | pad_value | Pad 填充值 |

| 15:7 | RO | 0x0 | — | 保留 |

| 6:4 | RW | 0x0 | pad_top | 反池化顶部 pad |

| 3 | RO | 0x0 | — | 保留 |

| 2:0 | RW | 0x0 | pad_left | 反池化左侧 pad |

RKNN_dpu_rdma_weight(0x5068)

四路 DMA 仲裁权重。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:24 | RW | 0x0 | e_weight | ERDMA 仲裁权重 |

| 23:16 | RW | 0x0 | n_weight | NRDMA 仲裁权重 |

| 15:8 | RW | 0x0 | b_weight | BRDMA 仲裁权重 |

| 7:0 | RW | 0x0 | m_weight | MRDMA 仲裁权重 |

RKNN_dpu_rdma_ew_surf_notch(0x506C)

EW surface notch。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | ew_surf_notch | EW surface notch |

| 3:0 | RO | 0x0 | — | 保留 |

PPU 寄存器块(Planar Processing Unit)

基址:CORE_BASE + 0x6000 | 地址范围:0x6000 ~ 0x6FFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

PPU 负责池化运算,支持平均池化、最大池化、最小池化,可与 DPU 流水线级联或独立 flying 模式运行。

RKNN_ppu_s_status(0x6000)

执行器状态寄存器(只读)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:18 | RO | 0x0 | — | 保留 |

| 17:16 | RO | 0x0 | status_1 | 执行器 1 状态。0:空闲;1:正在执行;2:正在执行且等待执行;3:保留 |

| 15:2 | RO | 0x0 | — | 保留 |

| 1:0 | RO | 0x0 | status_0 | 执行器 0 状态。编码同 status_1 |

RKNN_ppu_s_pointer(0x6004)

寄存器组指针与 ping-pong 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16 | RO | 0x0 | executer | 当前使用的寄存器组。0:组 0;1:组 1 |

| 15:6 | RO | 0x0 | — | 保留 |

| 5 | W1C | 0x0 | executer_pp_clear | 清除执行器组指针,写 1 清零 |

| 4 | W1C | 0x0 | pointer_pp_clear | 清除寄存器组指针,写 1 清零 |

| 3 | RW | 0x0 | pointer_pp_mode | Ping-pong 模式。0:按执行器切换;1:按指针切换 |

| 2 | RW | 0x0 | executer_pp_en | 执行器组 ping-pong 使能 |

| 1 | RW | 0x0 | pointer_pp_en | 寄存器组 ping-pong 使能 |

| 0 | RW | 0x0 | pointer | 当前待设置的寄存器组。0:组 0;1:组 1 |

RKNN_ppu_operation_enable(0x6008)

操作使能。写入触发 PPU 执行,此寄存器及之后均为 ping-pong 影子寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | op_en | PPU 操作使能。0:禁用;1:使能 |

RKNN_ppu_data_cube_in_width(0x600C)

池化输入 cube 宽度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_in_width | 池化输入宽度(需减 1) |

RKNN_ppu_data_cube_in_height(0x6010)

池化输入 cube 高度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_in_height | 池化输入高度(需减 1) |

RKNN_ppu_data_cube_in_channel(0x6014)

池化输入 cube 通道数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_in_channel | 池化输入通道数(需减 1) |

RKNN_ppu_data_cube_out_width(0x6018)

池化输出 cube 宽度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_out_width | 池化输出宽度(需减 1) |

RKNN_ppu_data_cube_out_height(0x601C)

池化输出 cube 高度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_out_height | 池化输出高度(需减 1) |

RKNN_ppu_data_cube_out_channel(0x6020)

池化输出 cube 通道数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_out_channel | 池化输出通道数(需减 1) |

RKNN_ppu_operation_mode_cfg(0x6024)

操作模式配置:池化方法、flying mode、notch、索引输出。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31 | RO | 0x0 | — | 保留 |

| 30 | RW | 0x0 | index_en | 使能输出每个 kernel 的位置索引 |

| 29 | RO | 0x0 | — | 保留 |

| 28:16 | RW | 0x0 | notch_addr | 宽度末尾到 shape 行末的像素数 |

| 15:8 | RO | 0x0 | — | 保留 |

| 7:5 | RW | 0x0 | use_cnt | use_cnt |

| 4 | RW | 0x0 | flying_mode | 池化 cube 来源。0:DPU;1:外部 |

| 3:2 | RO | 0x0 | — | 保留 |

| 1:0 | RW | 0x0 | pooling_method | 池化方法。0:平均池化;1:最大池化;2:最小池化;3:保留 |

RKNN_ppu_pooling_kernel_cfg(0x6034)

池化 kernel 大小与步长。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:24 | RO | 0x0 | — | 保留 |

| 23:20 | RW | 0x0 | kernel_stride_height | Kernel 步长高度(需减 1) |

| 19:16 | RW | 0x0 | kernel_stride_width | Kernel 步长宽度(需减 1) |

| 15:12 | RO | 0x0 | — | 保留 |

| 11:8 | RW | 0x0 | kernel_height | Kernel 高度(需减 1) |

| 7:4 | RO | 0x0 | — | 保留 |

| 3:0 | RW | 0x0 | kernel_width | Kernel 宽度(需减 1) |

RKNN_ppu_recip_kernel_width(0x6038)

Kernel 宽度倒数(用于平均池化计算)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16:0 | RW | 0x0 | recip_kernel_width | Shape kernel 宽度的倒数 × 2^16 |

RKNN_ppu_recip_kernel_height(0x603C)

Kernel 高度倒数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16:0 | RW | 0x0 | recip_kernel_height | Shape kernel 高度的倒数 × 2^16 |

RKNN_ppu_pooling_padding_cfg(0x6040)

池化四边 padding。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:15 | RO | 0x0 | — | 保留 |

| 14:12 | RW | 0x0 | pad_bottom | 底部 pad |

| 11 | RO | 0x0 | — | 保留 |

| 10:8 | RW | 0x0 | pad_right | 右侧 pad |

| 7 | RO | 0x0 | — | 保留 |

| 6:4 | RW | 0x0 | pad_top | 顶部 pad |

| 3 | RO | 0x0 | — | 保留 |

| 2:0 | RW | 0x0 | pad_left | 左侧 pad |

RKNN_ppu_padding_value_1_cfg(0x6044)

Pad 填充值低 32 位。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | pad_value_0 | pad_value×1 [31:0] |

RKNN_ppu_padding_value_2_cfg(0x6048)

Pad 填充值高 3 位。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:3 | RO | 0x0 | — | 保留 |

| 2:0 | RW | 0x0 | pad_value_1 | pad_value×1 [34:32] |

RKNN_ppu_dst_base_addr(0x6070)

输出 cube 目标基址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | dst_base_addr | 输出 cube 目标基址 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_ppu_dst_surf_stride(0x607C)

输出 surface 步长。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | dst_surf_stride | 输出 shape 面积 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_ppu_data_format(0x6084)

数据格式配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | index_add | 若 index_en 使能,值为 dst_surface_stride × cube surface 数(每 surface 8 字节),否则等于 dst_surface_stride |

| 3 | RW | 0x0 | dpu_flyin | 数据来自 DPU 且 DPU 数据来自外部时置 1 |

| 2:0 | RW | 0x0 | proc_precision | 处理精度 |

RKNN_ppu_misc_ctrl(0x60DC)

杂项控制:非对齐模式、多 surface 输出、burst。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RW | 0x0 | surf_len | Surface 计数长度 |

| 15:9 | RO | 0x0 | — | 保留 |

| 8 | RW | 0x0 | mc_surf_out | 多 surface 输出使能 |

| 7 | RW | 0x0 | nonalign | 非对齐模式使能 |

| 6:4 | RO | 0x0 | — | 保留 |

| 3:0 | RW | 0x0 | burst_len | Burst 长度。3:Burst4;7:Burst8;15:Burst16 |

PPU_RDMA 寄存器块

基址:CORE_BASE + 0x7000 | 地址范围:0x7000 ~ 0x7FFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

PPU_RDMA 负责为 PPU 从外部内存读取池化输入特征数据(flying 模式下使用)。

RKNN_ppu_rdma_s_status(0x7000)

执行器状态寄存器(只读)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:18 | RO | 0x0 | — | 保留 |

| 17:16 | RO | 0x0 | status_1 | 执行器 1 状态。0:空闲;1:正在执行;2:正在执行且等待执行;3:保留 |

| 15:2 | RO | 0x0 | — | 保留 |

| 1:0 | RO | 0x0 | status_0 | 执行器 0 状态。编码同 status_1 |

RKNN_ppu_rdma_s_pointer(0x7004)

寄存器组指针与 ping-pong 控制。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:17 | RO | 0x0 | — | 保留 |

| 16 | RO | 0x0 | executer | 当前使用的寄存器组。0:组 0;1:组 1 |

| 15:6 | RO | 0x0 | — | 保留 |

| 5 | W1C | 0x0 | executer_pp_clear | 清除执行器组指针,写 1 清零 |

| 4 | W1C | 0x0 | pointer_pp_clear | 清除寄存器组指针,写 1 清零 |

| 3 | RW | 0x0 | pointer_pp_mode | Ping-pong 模式。0:按执行器切换;1:按指针切换 |

| 2 | RW | 0x0 | executer_pp_en | 执行器组 ping-pong 使能 |

| 1 | RW | 0x0 | pointer_pp_en | 寄存器组 ping-pong 使能 |

| 0 | RW | 0x0 | pointer | 当前待设置的寄存器组。0:组 0;1:组 1 |

RKNN_ppu_rdma_operation_enable(0x7008)

操作使能。写入触发 PPU_RDMA 执行,此寄存器及之后均为 ping-pong 影子寄存器。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | op_en | PPU_RDMA 操作使能。0:禁用;1:使能 |

RKNN_ppu_rdma_cube_in_width(0x700C)

池化输入 cube 宽度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_in_width | 池化 cube 宽度(需减 1) |

RKNN_ppu_rdma_cube_in_height(0x7010)

池化输入 cube 高度。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_in_height | 池化 cube 高度(需减 1) |

RKNN_ppu_rdma_cube_in_channel(0x7014)

池化输入 cube 通道数。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12:0 | RW | 0x0 | cube_in_channel | 池化 cube 通道数(需减 1) |

RKNN_ppu_rdma_src_base_addr(0x701C)

池化 cube 源基址。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | src_base_addr | 池化 cube 基址 |

RKNN_ppu_rdma_src_line_stride(0x7024)

源行步长(shape 宽度)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | src_line_stride | 池化 cube shape 宽度 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_ppu_rdma_src_surf_stride(0x7028)

源 surface 步长(shape 面积)。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:4 | RW | 0x0 | src_surf_stride | 池化 cube shape 面积 |

| 3:0 | RO | 0x0 | — | 保留 |

RKNN_ppu_rdma_data_format(0x7030)

输入数据格式。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:2 | RO | 0x0 | — | 保留 |

| 1:0 | RW | 0x0 | in_precision | 输入精度。0:4bit;1:8bit;2:16bit;3:32bit |

DDMA / SDMA 寄存器块(Data DMA / System DMA)

DDMA 基址:CORE_BASE + 0x8000 | 地址范围:0x8000 ~ 0x8FFF

SDMA 基址:CORE_BASE + 0x9000 | 地址范围:0x9000 ~ 0x9FFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

DDMA 和 SDMA 寄存器布局完全一致,仅基址不同(DDMA 0x8xxx,SDMA 0x9xxx)。DDMA 用于数据搬运,SDMA 用于系统级搬运。以下以 DDMA 为例展开位域,SDMA 将偏移 0x8xxx 替换为 0x9xxx 即可。

cfg_outstanding(DDMA: 0x8000 / SDMA: 0x9000)

读写 outstanding 数配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:8 | RW | 0x0 | wr_os_cnt | 最大写 outstanding 数 |

| 7:0 | RW | 0x0 | rd_os_cnt | 最大读 outstanding 数 |

rd_weight_0(DDMA: 0x8004 / SDMA: 0x9004)

读仲裁权重 0:各模块读 burst 权重。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:24 | RW | 0x0 | rd_weight_pdp | PPU 读 burst 权重 |

| 23:16 | RW | 0x0 | rd_weight_dpu | DPU 读 burst 权重 |

| 15:8 | RW | 0x0 | rd_weight_kernel | 权重读 burst 权重 |

| 7:0 | RW | 0x0 | rd_weight_feature | 特征读 burst 权重 |

wr_weight_0(DDMA: 0x8008 / SDMA: 0x9008)

写仲裁权重。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:16 | RO | 0x0 | — | 保留 |

| 15:8 | RW | 0x0 | wr_weight_pdp | PPU 写权重 |

| 7:0 | RW | 0x0 | wr_weight_dpu | DPU 写权重 |

cfg_id_error(DDMA: 0x800C / SDMA: 0x900C)

错误 ID 记录。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:10 | RO | 0x0 | — | 保留 |

| 9:6 | RW | 0x0 | wr_resp_id | 错误写 ID |

| 5 | RO | 0x0 | — | 保留 |

| 4:0 | RW | 0x0 | rd_resp_id | 错误读 ID |

rd_weight_1(DDMA: 0x8010 / SDMA: 0x9010)

读仲裁权重 1:PC 读 burst 权重。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:8 | RO | 0x0 | — | 保留 |

| 7:0 | RW | 0x0 | rd_weight_pc | PC 读 burst 权重 |

cfg_dma_fifo_clr(DDMA: 0x8014 / SDMA: 0x9014)

清除 DMA FIFO。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | dma_fifo_clr | 清除 DMA FIFO |

cfg_dma_arb(DDMA: 0x8018 / SDMA: 0x9018)

DMA 仲裁模式配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:10 | RO | 0x0 | — | 保留 |

| 9 | RW | 0x0 | wr_arbit_model | 写仲裁模型 |

| 8 | RW | 0x0 | rd_arbit_model | 读仲裁模型 |

| 7 | RO | 0x0 | — | 保留 |

| 6:4 | RW | 0x0 | wr_fix_arb | 写固定仲裁 |

| 3 | RO | 0x0 | — | 保留 |

| 2:0 | RW | 0x0 | rd_fix_arb | 读固定仲裁 |

cfg_dma_rd_qos(DDMA: 0x8020 / SDMA: 0x9020)

各模块读 QoS 配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:10 | RO | 0x0 | — | 保留 |

| 9:8 | RW | 0x0 | rd_pc_qos | PC 读 QoS |

| 7:6 | RW | 0x0 | rd_ppu_qos | PPU 读 QoS |

| 5:4 | RW | 0x0 | rd_dpu_qos | DPU 读 QoS |

| 3:2 | RW | 0x0 | rd_kernel_qos | Kernel 读 QoS |

| 1:0 | RW | 0x0 | rd_feature_qos | Feature 读 QoS |

cfg_dma_rd_cfg(DDMA: 0x8024 / SDMA: 0x9024)

AXI 读通道信号配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12 | RW | 0x0 | rd_arlock | AXI arlock |

| 11:8 | RW | 0x0 | rd_arcache | AXI arcache |

| 7:5 | RW | 0x0 | rd_arprot | AXI arprot |

| 4:3 | RW | 0x0 | rd_arburst | AXI arburst |

| 2:0 | RW | 0x0 | rd_arsize | AXI arsize |

cfg_dma_wr_cfg(DDMA: 0x8028 / SDMA: 0x9028)

AXI 写通道信号配置。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:13 | RO | 0x0 | — | 保留 |

| 12 | RW | 0x0 | wr_awlock | AXI awlock |

| 11:8 | RW | 0x0 | wr_awcache | AXI awcache |

| 7:5 | RW | 0x0 | wr_awprot | AXI awprot |

| 4:3 | RW | 0x0 | wr_awburst | AXI awburst |

| 2:0 | RW | 0x0 | wr_awsize | AXI awsize |

cfg_dma_wstrb(DDMA: 0x802C / SDMA: 0x902C)

AXI 写选通。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RW | 0x0 | wr_wstrb | AXI 写选通信号 |

cfg_status(DDMA: 0x8030 / SDMA: 0x9030)

DMA 状态。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:9 | RO | 0x0 | — | 保留 |

| 8 | RW | 0x0 | idel | 空闲状态 |

| 7:0 | RO | 0x0 | — | 保留 |

dt_wr_amount(DDMA: 0x8034 / SDMA: 0x9034)

数据写入量统计。用于 ioctl GetDtWrAmount。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RO | 0x0 | dt_wr_amount | 数据写入量 |

dt_rd_amount(DDMA: 0x8038 / SDMA: 0x9038)

数据读取量统计。用于 ioctl GetDtRdAmount。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RO | 0x0 | dt_rd_amount | 数据读取量 |

wt_rd_amount(DDMA: 0x803C / SDMA: 0x903C)

权重读取量统计。用于 ioctl GetWtRdAmount。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:0 | RO | 0x0 | wt_rd_amount | 权重读取量 |

清除操作:写

rd_weight_1(0x8010) 值0x80000101再写0x00000101(两次写入进行 latch/clear)。

GLOBAL 寄存器块(全局使能)

基址:CORE_BASE + 0xF000 | 地址范围:0xF000 ~ 0xFFFF

来源:RK3588 TRM §36.4.3 Detail Registers Description

GLOBAL 模块仅包含一个寄存器,用于一次性组合使能各功能模块的操作。

RKNN_global_operation_enable(0xF008)

组合操作使能:一次写入同时触发多个模块开始执行。

| Bit | 属性 | 复位值 | 字段名 | 描述 |

|---|---|---|---|---|

| 31:7 | RO | 0x0 | — | 保留 |

| 6 | RW | 0x0 | ppu_rdma_op_en | PPU_RDMA 操作使能 |

| 5 | RW | 0x0 | ppu_op_en | PPU 操作使能 |

| 4 | RW | 0x0 | dpu_rdma_op_en | DPU_RDMA 操作使能 |

| 3 | RW | 0x0 | dpu_op_en | DPU 操作使能 |

| 2 | RW | 0x0 | core_op_en | CORE 操作使能 |

| 1 | RO | 0x0 | — | 保留 |

| 0 | RW | 0x0 | cna_op_en | CNA 操作使能 |

IOCTL 协议与数据结构

本章整理 RKNPU 驱动的全部 ioctl 命令、传参结构体布局、flags 枚举,以及 mmap(offset) 编码规则。

1. IOCTL 命令表

RKNPU 驱动提供 6 个 ioctl 命令,同时定义了两套编号:

| 命令 | 编号 | DRM 路径宏 | 非 DRM 路径宏 | 方向 | 结构体 | 功能 |

|---|---|---|---|---|---|---|

| ACTION | 0x00 |

DRM_IOCTL_RKNPU_ACTION |

IOCTL_RKNPU_ACTION |

IOWR | rknpu_action |

查询/设置:版本、频率、电压、电源、统计、复位等 |

| SUBMIT | 0x01 |

DRM_IOCTL_RKNPU_SUBMIT |

IOCTL_RKNPU_SUBMIT |

IOWR | rknpu_submit |

提交 NPU 任务(PC job) |

| MEM_CREATE | 0x02 |

DRM_IOCTL_RKNPU_MEM_CREATE |

IOCTL_RKNPU_MEM_CREATE |

IOWR | rknpu_mem_create |

分配 DMA buffer(GEM 对象) |

| MEM_MAP | 0x03 |

DRM_IOCTL_RKNPU_MEM_MAP |

IOCTL_RKNPU_MEM_MAP |

IOWR | rknpu_mem_map |

获取 mmap 用的 fake offset |

| MEM_DESTROY | 0x04 |

DRM_IOCTL_RKNPU_MEM_DESTROY |

IOCTL_RKNPU_MEM_DESTROY |

IOWR | rknpu_mem_destroy |

释放 DMA buffer |

| MEM_SYNC | 0x05 |

DRM_IOCTL_RKNPU_MEM_SYNC |

IOCTL_RKNPU_MEM_SYNC |

IOWR | rknpu_mem_sync |

Cache 同步(flush / invalidate) |

1.1 两套编号的区别

| DRM 路径 | 非 DRM 路径 | |

|---|---|---|

| 编码方式 | DRM_IOWR(DRM_COMMAND_BASE + nr, type) |

_IOWR('r', nr, type) |

| 设备节点 | /dev/dri/cardX |

/dev/rknpu(如果驱动注册了) |

| 调用方式 | drmIoctl(fd, DRM_IOCTL_RKNPU_*, &arg) |

ioctl(fd, IOCTL_RKNPU_*, &arg) |

| 闭源库使用 | librknnrt.so 主要走此路径 |

备选 |

rknpu-ioctl.h 中

RKNPU_IOC_MAGIC = 'r',DRM_COMMAND_BASE来自<libdrm/drm.h>(通常为0x40)。

2. 结构体布局

2.1 struct rknpu_action(8 字节)

用于 ACTION ioctl,查询/设置各种属性。

| 偏移 | 大小 | 类型 | 字段 | 说明 |

|---|---|---|---|---|

0x00 | 4 | __u32 | flags | Action 编号(见 §3.4) |

0x04 | 4 | __u32 | value | GET 时为返回值,SET 时为输入值 |

2.2 struct rknpu_mem_create(40 字节)

| 偏移 | 大小 | 类型 | 字段 | 方向 | 说明 |

|---|---|---|---|---|---|

0x00 | 4 | __u32 | handle | OUT | GEM 对象句柄(驱动分配) |

0x04 | 4 | __u32 | flags | IN | 内存类型 flags(见 §3.1) |

0x08 | 8 | __u64 | size | IN | 申请大小(内部页对齐) |

0x10 | 8 | __u64 | obj_addr | OUT | 内核对象地址(opaque token) |

0x18 | 8 | __u64 | dma_addr | OUT | 设备侧 DMA 地址(IOVA 或物理地址) |

0x20 | 8 | __u64 | sram_size | IN | 可选 SRAM 申请大小 |

StarryOS Rust 驱动 扩展了额外字段:

iommu_domain_id: i32、core_mask: u32,用于多核/IOMMU 域管理。

2.3 struct rknpu_mem_map(16 字节)

| 偏移 | 大小 | 类型 | 字段 | 方向 | 说明 |

|---|---|---|---|---|---|

0x00 | 4 | __u32 | handle | IN | GEM 句柄 |

0x04 | 4 | __u32 | reserved | — | 64 位对齐填充 |

0x08 | 8 | __u64 | offset | OUT | fake offset,用于 mmap(fd, ..., offset) |

2.4 struct rknpu_mem_destroy(16 字节)

| 偏移 | 大小 | 类型 | 字段 | 方向 | 说明 |

|---|---|---|---|---|---|

0x00 | 4 | __u32 | handle | IN | GEM 句柄 |

0x04 | 4 | __u32 | reserved | — | 填充 |

0x08 | 8 | __u64 | obj_addr | IN | 内核对象地址 |

2.5 struct rknpu_mem_sync(32 字节)

| 偏移 | 大小 | 类型 | 字段 | 方向 | 说明 |

|---|---|---|---|---|---|

0x00 | 4 | __u32 | flags | IN | 同步方向(见 §3.2) |

0x04 | 4 | __u32 | reserved | — | 填充 |

0x08 | 8 | __u64 | obj_addr | IN | 要同步的内核对象地址 |

0x10 | 8 | __u64 | offset | IN | 同步起始偏移(字节) |

0x18 | 8 | __u64 | size | IN | 同步区域大小 |

2.6 struct rknpu_task(36 字节,__packed)

单个任务描述,由 PC 命令流引擎解释执行。

| 偏移 | 大小 | 类型 | 字段 | 说明 |

|---|---|---|---|---|

0x00 | 4 | __u32 | flags | 任务标志 |

0x04 | 4 | __u32 | op_idx | 算子索引 |

0x08 | 4 | __u32 | enable_mask | 模块使能掩码 |

0x0C | 4 | __u32 | int_mask | 期望的完成中断掩码 |

0x10 | 4 | __u32 | int_clear | 中断清除值 |

0x14 | 4 | __u32 | int_status | 完成后驱动写回实际中断状态 |

0x18 | 4 | __u32 | regcfg_amount | 寄存器配置项数量 |

0x1C | 4 | __u32 | regcfg_offset | 寄存器配置在命令流中的偏移 |

0x20 | 8 | __u64 | regcmd_addr | 寄存器命令流 DMA 地址 |

__packed:编译器不插入 padding,保证与内核侧布局一致。

2.7 struct rknpu_subcore_task(8 字节)

| 偏移 | 大小 | 类型 | 字段 | 说明 |

|---|---|---|---|---|

0x00 | 4 | __u32 | task_start | 该子核心的起始 task 索引 |

0x04 | 4 | __u32 | task_number | 该子核心要执行的 task 数量 |

2.8 struct rknpu_submit(96 字节)

任务提交主结构体,驱动最核心的入口。

| 偏移 | 大小 | 类型 | 字段 | 说明 |

|---|---|---|---|---|

0x00 | 4 | __u32 | flags | Job 模式(见 §3.3) |

0x04 | 4 | __u32 | timeout | 超时时间(ms) |

0x08 | 4 | __u32 | task_start | 全局起始 task 索引 |

0x0C | 4 | __u32 | task_number | 全局 task 数量 |

0x10 | 4 | __u32 | task_counter | 计数/序列号 |

0x14 | 4 | __s32 | priority | 调度优先级 |

0x18 | 8 | __u64 | task_obj_addr | task 数组的内核对象地址 |

0x20 | 8 | __u64 | regcfg_obj_addr | 寄存器配置对象地址 |

0x28 | 8 | __u64 | task_base_addr | task 基址(设备侧) |

0x30 | 8 | __u64 | user_data | 可选用户数据(透传/调试) |

0x38 | 4 | __u32 | core_mask | 核心选择掩码(bit0=core0, bit1=core1, bit2=core2) |

0x3C | 4 | __s32 | fence_fd | dma-fence fd(IN: fence_in, OUT: fence_out) |

0x40 | 40 | subcore_task[5] | subcore_task | 5 组子核心任务分配 |

StarryOS Rust 驱动 变体:将

regcfg_obj_addr替换为iommu_domain_id+reserved,并增加hw_elapse_time字段。

3. Flags 枚举

3.1 enum e_rknpu_mem_type(内存类型,位掩码)

| 值 | 名称 | 说明 |

|---|---|---|

0 << 0 | CONTIGUOUS | 物理连续(默认) |

1 << 0 | NON_CONTIGUOUS | 物理不连续 |

0 << 1 | NON_CACHEABLE | 不可缓存(默认) |

1 << 1 | CACHEABLE | 可缓存 |

1 << 2 | WRITE_COMBINE | Write-Combine 映射 |

1 << 3 | KERNEL_MAPPING | 内核态映射 |

1 << 4 | IOMMU | IOMMU 映射 |

1 << 5 | ZEROING | 分配后清零 |

1 << 6 | SECURE | 安全内存 |

1 << 7 | NON_DMA32 | 不限于 DMA32 区域 |

1 << 8 | TRY_ALLOC_SRAM | 尝试分配 SRAM |

MEM_MASK = 0x1FF(bit0~bit8 的合法组合集)

3.2 enum e_rknpu_mem_sync_mode(Cache 同步方向)

| 值 | 名称 | 说明 |

|---|---|---|

1 << 0 | SYNC_TO_DEVICE | CPU → 设备:flush cache |

1 << 1 | SYNC_FROM_DEVICE | 设备 → CPU:invalidate cache |

3.3 enum e_rknpu_job_mode(Job 模式,位掩码)

| 值 | 名称 | 说明 |

|---|---|---|

0 << 0 | SLAVE | 从模式(默认) |

1 << 0 | PC | PC(Program Counter)模式 |

0 << 1 | BLOCK | 阻塞等待完成(默认) |

1 << 1 | NONBLOCK | 非阻塞返回 |

1 << 2 | PINGPONG | 双缓冲/流水模式 |

1 << 3 | FENCE_IN | 等待输入 fence |

1 << 4 | FENCE_OUT | 返回输出 fence fd |

3.4 enum e_rknpu_action(Action 编号)

| 编号 | 名称 | 方向 | 说明 |

|---|---|---|---|

| 0 | GET_HW_VERSION | GET | 读取硬件版本 |

| 1 | GET_DRV_VERSION | GET | 读取驱动版本(编码:major*10000+minor*100+patch) |

| 2 | GET_FREQ | GET | 读取当前频率 |

| 3 | SET_FREQ | SET | 设置频率 |

| 4 | GET_VOLT | GET | 读取电压 |

| 5 | SET_VOLT | SET | 设置电压 |

| 6 | ACT_RESET | ACT | NPU 软复位 |

| 7 | GET_BW_PRIORITY | GET | 带宽优先级 |

| 8 | SET_BW_PRIORITY | SET | 设置带宽优先级 |

| 9 | GET_BW_EXPECT | GET | 期望带宽 |

| 10 | SET_BW_EXPECT | SET | 设置期望带宽 |

| 11 | GET_BW_TW | GET | 带宽时间窗 |

| 12 | SET_BW_TW | SET | 设置带宽时间窗 |

| 13 | ACT_CLR_TOTAL_RW_AMOUNT | ACT | 清除读写量统计 |

| 14 | GET_DT_WR_AMOUNT | GET | 数据写入量 |

| 15 | GET_DT_RD_AMOUNT | GET | 数据读取量 |

| 16 | GET_WT_RD_AMOUNT | GET | 权重读取量 |

| 17 | GET_TOTAL_RW_AMOUNT | GET | 总读写量 |

| 18 | GET_IOMMU_EN | GET | IOMMU 是否启用 |

| 19 | SET_PROC_NICE | SET | 进程优先级 |